تشكيل البنية التحتية للـ AI بقيمة تريليون دولار: دليل القادة

تتضاعف وتيرة الاستثمار في عالم الـ AI بوتيرة غير مسبوقة. فقد أعلنت NVIDIA في مؤتمر GTC 2026 عن مضاعفة توقعاتها للطلب على رقائق الذكاء الاصطناعي لتصل إلى تريليون دولار. وفي خطوة تعكس هذا الزخم الهائل، يخطط كبار مزودي الخدمات السحابية (Hyperscalers) لاستثمار 720 مليار دولار في نفقات رأسمالية هذا العام. فماذا يعني هذا الحجم الهائل من الاستثمار في البنية التحتية بالنسبة لكم، كقادة أعمال ومطورين؟

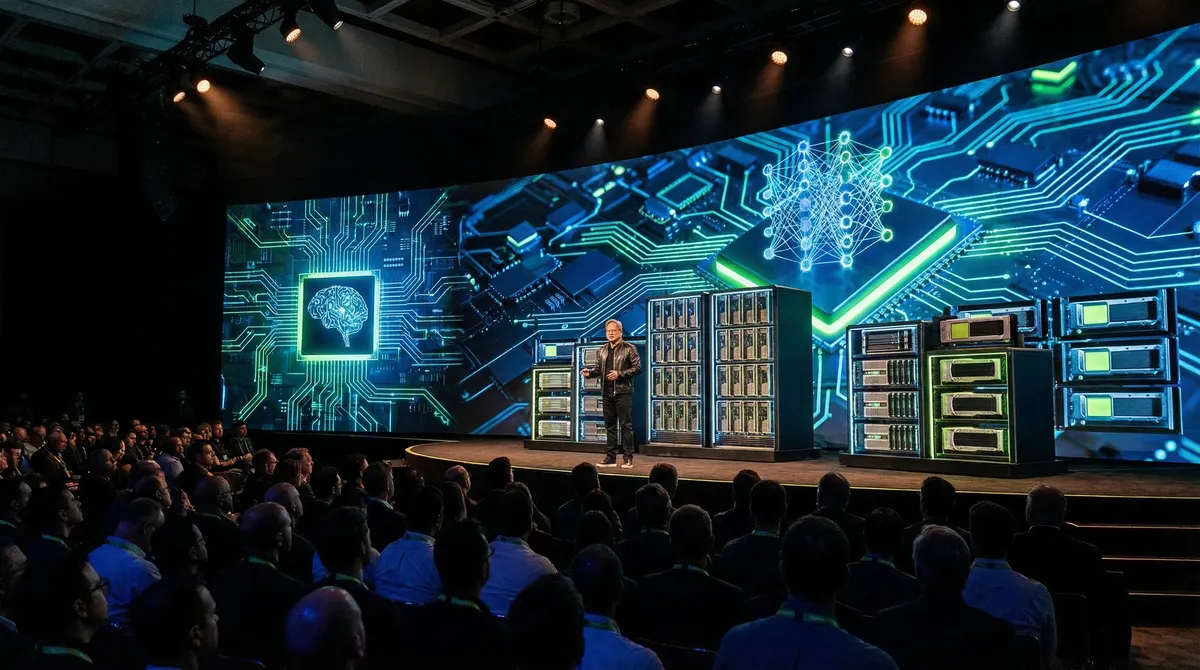

خلال مؤتمر GTC 2026، الذي عُقد في 17 مارس، رفع Jensen Huang، الرئيس التنفيذي لشركة NVIDIA، سقف توقعاته للطلب على منتجات شركته، مصرحاً: "تريليون دولار على الأقل حتى عام 2027". وأردف قائلاً: "في الواقع، سنواجه نقصاً؛ فأنا على يقين بأن الطلب على الحوسبة سيتجاوز ذلك بكثير". تجدر الإشارة إلى أن التقدير السابق، الصادر خلال مكالمة أرباح NVIDIA في فبراير، كان يبلغ 500 مليار دولار، مما يعكس تضاعف الفرصة المتوقعة في غضون شهر واحد فقط.

لا يُعد هذا المؤشر حالة فردية؛ فقد أعلنت كبرى أربع شركات مزودة للخدمات السحابية فائقة النطاق (Hyperscalers) — Alphabet وMeta وMicrosoft وAmazon — عن خطط لإنفاق جماعي يناهز 700 مليار دولار في النفقات الرأسمالية لعام 2026. وفي خطوة منفردة، أبرمت Meta صفقة بنية تحتية بقيمة 27 مليار دولار مع Nebius، وتعتزم إنفاق ما يصل إلى 135 مليار دولار في نفقات رأسمالية مرتبطة بـ AI هذا العام. بدورها، خصصت Amazon مبلغ 200 مليار دولار للإنفاق، متجاوزة بذلك توقعات المحللين بـ 50 مليار دولار.

بالنسبة للمطورين والمؤسسين والقادة التقنيين، تحمل هذه الأرقام في طياتها تحولات جوهرية تطال جوانب متعددة: من توافر الحوسبة وتكلفتها، إلى منهجيات بناء التطبيقات، وصولاً إلى القرارات الحاسمة المتعلقة بالبنية التحتية خلال الأشهر الـ 12 إلى 18 المقبلة.

الأبعاد الحقيقية لبناء البنية التحتية لـ AI

يقترب إجمالي النفقات الرأسمالية المخصصة لـ AI من قبل مزودي الـ Hyperscalers لعام 2026 من 720 مليار دولار، وذلك عند الحد الأقصى للنطاقات التوجيهية. ولتوضيح حجم هذا الإنفاق، فإنه يعادل الناتج المحلي الإجمالي لدولة السويد، ويتجاوز ضعف التكلفة الإجمالية لبرنامج Apollo بعد تعديلها وفقاً للتضخم. في سياق متصل، بلغت إيرادات NVIDIA للسنة المالية 2026 نحو 215.9 مليار دولار، مسجلة نمواً سنوياً بنسبة 65%، فيما وصلت إيرادات مراكز البيانات وحدها إلى 62.3 مليار دولار للربع الرابع.

وفقاً لشركة Gartner، من المتوقع أن يتجاوز الإنفاق العالمي على تكنولوجيا المعلومات حاجز الـ 6 تريليونات دولار لأول مرة في عام 2026. وتُعد أعباء عمل AI المحرك الأساسي لهذا النمو، حيث أفادت 42% من المؤسسات بأن تحسين سير عمل AI يمثل الأولوية القصوى في خطط إنفاقها.

أين تتجه الاستثمارات؟

يتوزع الإنفاق عبر عدة فئات رئيسية، تؤثر كل منها بشكل مباشر على منظومة المطورين:

توفير وحدات معالجة الرسومات (GPU) والمسرعات. لا تزال رقائق Blackwell وRubin من NVIDIA في صدارة أولويات الطلب. ويعكس توقع التريليون دولار الطلب المتزايد على الاستدلال (Inference) — أي تشغيل النماذج المدربة في بيئة الإنتاج — بقدر ما يعكس الطلب على التدريب (Training). وقد شدد Jensen Huang بشكل خاص على هذا التحول نحو أعباء عمل الاستدلال كفرصة إيرادات كبرى.

بناء مراكز البيانات. يجري تشييد مرافق جديدة بمقاييس غير مسبوقة. وتشمل صفقة Meta البالغة 27 مليار دولار مع Nebius نشر بنية تحتية لـ AI عبر مناطق متعددة. كما تعمل كل من Microsoft وAmazon وGoogle على بناء منشآت ضخمة مصممة خصيصاً لأعباء عمل AI، مزودة بأنظمة تبريد متخصصة وهياكل متطورة لتوصيل الطاقة.

البنية التحتية للطاقة. تستهلك مراكز بيانات AI كميات هائلة من الكهرباء تفوق بكثير استهلاك المرافق السحابية التقليدية. وقد استدعى ذلك بناء بنية تحتية موازية في قطاع الطاقة، تشمل توليد طاقة جديد، وتحديث الشبكات، ومرافق توليد في الموقع. إن حجم الطلب على الطاقة كبير لدرجة أن NVIDIA أعلنت عن مفاهيم الحوسبة القائمة على الفضاء في GTC 2026، وناقش Elon Musk الحوسبة المدارية كحل محتمل لقيود الطاقة الأرضية.

الشبكات والربط البيني. تُعد الاتصالات عالية النطاق الترددي بين مجموعات GPU وبين مراكز البيانات نقطة إنفاق متزايدة. وتُعالج تقنيات NVLink وInfiniBand من NVIDIA الاتصالات داخل المجموعات، بينما يستثمر الـ Hyperscalers في شبكات ألياف ضوئية مخصصة تربط بين المناطق.

اقتصاد الاستدلال (Inference): تحول هيكلي

يستهدف توقع NVIDIA البالغ تريليون دولار بشكل خاص فرصة الاستدلال (Inference). ففي حين يمثل تدريب نموذج كبير تكلفة لمرة واحدة (أو دورية)، فإن تشغيل هذا النموذج على نطاق واسع — أي الاستدلال — هو عملية مستمرة تتوسع مع تزايد طلب المستخدمين.

يحمل هذا التحول أهمية بالغة للمطورين والمؤسسين لعدة أسباب:

| الجانب | عصر التدريب (Training) | عصر الاستدلال (Inference) |

|---|---|---|

| هيكل التكلفة | مسبق، على دفعات | مستمر، لكل طلب |

| أولوية الأجهزة | قوة حوسبة خام | زمن الاستجابة + معدل النقل |

| مخاوف التوسع | حجم النموذج | المستخدمون المتزامنون |

| التأثير على المطورين | فرق قليلة تدرب النماذج | كل تطبيق يشغل الاستدلال |

| نموذج العمل | مدفوع بالأبحاث | مدفوع بالاستخدام |

يعني اقتصاد الاستدلال أن تكلفة وتوافر تشغيل نماذج AI في بيئة الإنتاج يحددان بشكل مباشر جدوى التطبيقات الاقتصادية. ومع التوسع المستمر في البنية التحتية، من المتوقع أن تنخفض تكاليف الاستدلال، مما يفسح المجال لظهور فئات جديدة من التطبيقات التي كانت مكلفة للغاية في السابق.

ماذا يعني هذا للمطورين؟

الحوسبة تصبح أكثر سهولة في الوصول، وليس العكس. على الرغم من الأرقام الهائلة للنفقات الرأسمالية، فإن وتيرة البناء تزيد العرض بشكل أسرع من الطلب في العديد من مستويات أعباء العمل. تتوسع واجهات برمجة تطبيقات الاستدلال بدون خادم (Serverless Inference APIs) من مزودي السحابة، ونقاط نهاية الاستدلال المتخصصة من بائعي النماذج، وخيارات النشر على الحافة (Edge). وعليه، سيشهد المطورون الذين يبنون تطبيقاتهم فوق النماذج الأساسية تحسناً ملحوظاً في نسب السعر إلى الأداء خلال عامي 2026 و2027.

استراتيجيات السحابة المتعددة والمزودين المتعددين أصبحت ضرورية الآن. لا يستطيع مزود واحد استيعاب كامل حجم الطلب. لذا، يجب على المطورين تصميم تطبيقاتهم للعمل عبر مزودين مختلفين، بالاعتماد على طبقات تجريد تتيح التبديل السلس بين نقاط نهاية الاستدلال. وهذا أمر حيوي بشكل خاص للشركات الناشئة التي قد لا ترغب في الالتزام بمسار تسعير مزود واحد.

تسارع الاستدلال على الحافة (Edge Inference). ليست كل أعباء العمل تتطلب وحدات GPU في مراكز البيانات. فمنصات Apple Silicon ومسرعات AI من Qualcomm ومنصة Jetson من NVIDIA تتيح استدلالاً فعالاً عند الحافة. وبالنسبة للتطبيقات الحساسة لزمن الاستجابة (مثل الترجمة الفورية، الأنظمة المستقلة، والمساعدين على الجهاز)، فإن بناء البنية التحتية يشمل الحوسبة المحلية، وليس فقط النطاق السحابي.

نسبة النموذج إلى البنية التحتية تتغير. مع التوسع في البنية التحتية، يتحول عنق الزجاجة من التساؤل "هل يمكننا تشغيل هذا النموذج؟" إلى "هل يمكننا تشغيله بكفاءة؟". وتصبح تقنيات مثل التكميم (Quantization)، والتقطير (Distillation)، وفك التشفير التخميني (Speculative decoding)، وهياكل خليط الخبراء (Mixture-of-experts) مهارات أساسية للمطورين، متجاوزة كونها مجرد مواضيع بحثية.

ماذا يعني هذا للمؤسسين؟

تكاليف بنية AI التحتية أصبحت الآن بنداً أساسياً. بالنسبة لأي شركة ناشئة تعتمد على AI، فمن المرجح أن تكون تكاليف الحوسبة هي الفئة الأكبر أو الثانية الأكبر من النفقات. إن فهم كيفية تحسين تكاليف الاستدلال — من اختيار النموذج، إلى استراتيجيات الدفعات، وطبقات التخزين المؤقت، والتفاوض مع المزودين — يمثل كفاءة أساسية، وليس مجرد تمرين تحسين ثانوي.

نافذة الشركات الناشئة القائمة على AI مفتوحة ولكنها تضيق. يؤدي بناء الـ Hyperscalers إلى توفير قدرة هائلة ستُسهم في نهاية المطاف في تحويل العديد من قدرات AI إلى سلع استهلاكية (Commoditization). الشركات الناشئة التي تبني ميزة تنافسية مستدامة من خلال البيانات المملوكة، أو الضبط الدقيق لمجالات محددة، أو هياكل التطبيقات المبتكرة، لديها فرصة سانحة الآن، بينما لا تزال البنية التحتية قيد النشر. إن التنافس على قدرة النموذج الخام ضد شركات تنفق أكثر من 100 مليار دولار سنوياً ليس استراتيجية قابلة للاستمرار.

التوزيع الجغرافي مهم. لا يتم بناء البنية التحتية بشكل موحد؛ حيث تستحوذ الولايات المتحدة وأجزاء من أوروبا وأسواق آسيوية مختارة على النصيب الأكبر من القدرات الجديدة. لذا، يجب على المؤسسين الذين يستهدفون الأسواق الناشئة أن يأخذوا في الاعتبار زمن الاستجابة الأعلى والتكاليف المحتملة الأعلى لأعباء عمل AI في تلك المناطق.

اقتصاد الرموز (Token economics): لمحة عن كيفية إعادة تشكيل AI للتعويضات

خلال مؤتمر GTC 2026، كشف Jensen Huang عن مفهوم يعكس مدى تغلغل البنية التحتية لـ AI في العمليات التنظيمية: دفع أجور المهندسين بـ AI tokens كمكمل للراتب الأساسي.

"سيحتاج كل مهندس في شركتنا إلى ميزانية رموز سنوية"، صرح هوانغ. "سيتقاضون بضع مئات الآلاف سنوياً كراتب أساسي، وسأعطيهم على الأرجح نصف ذلك كرموز حتى يتمكنوا من مضاعفة إنتاجيتهم 10 مرات".

وفقاً للمستويات الموصوفة، سيتمكن المهندسون من الوصول إلى مليارات الرموز سنوياً. وقد صاغ هوانغ هذا المفهوم كأداة توظيف تنافسية، قائلاً: "لقد أصبح الآن أحد أدوات التوظيف في وادي السيليكون: كم عدد الرموز التي تأتي مع وظيفتي".

سواء أصبح التعويض بالرموز واسع الانتشار أم لا، فإن المنطق الكامن وراءه يحمل أهمية كبرى؛ فقد بدأت الشركات في التعامل مع حوسبة AI كمضاعف للإنتاجية ذي قيمة قابلة للقياس لكل موظف. وهذا بدوره له تداعيات على كيفية وضع المؤسسات لميزانياتها، وكيفية قياس إنتاجية المطورين، وكيفية هيكلة حزم التعويضات في الأسواق التنافسية.

المخاطر والأسئلة المفتوحة

هل هذه فقاعة؟ أشار كل من Satya Nadella، الرئيس التنفيذي لشركة Microsoft، والمستثمر Michael Burry إلى الإفراط في الاستثمار في AI كمصدر قلق. إلا أن الحجة المضادة تتمثل في أن نمو إيرادات NVIDIA (65% على أساس سنوي إلى 215.9 مليار دولار) يثبت أن الطلب حقيقي وقائم، وليس مجرد تكهنات. فالخطر لا يكمن في غياب الطلب، بل في احتمال أن يتجاوز بناء العرض الحد المطلوب في قطاعات معينة من السوق.

استدامة الطاقة. يُعد استهلاك الطاقة في مراكز بيانات AI عائقاً حقيقياً. يستثمر القطاع في الطاقة النووية والشمسية وتحديث الشبكات، لكن الجدول الزمني لتوليد الطاقة الجديدة لا يتوافق دائماً مع الجدول الزمني لنشر مراكز البيانات الجديدة.

مخاطر التركيز. تهيمن NVIDIA على غالبية سوق مسرعات AI. وقد كافحت AMD لسد الفجوة على الرغم من مناقشات صفقة رقائق بقيمة 100 مليار دولار مع Meta. يخلق هذا التركيز مخاطر في سلسلة التوريد للمنظومة بأكملها، ويُبقي قوة التسعير بقوة في يد NVIDIA.

أهم النقاط المستفادة

- ضاعفت NVIDIA توقعاتها للطلب على رقائق AI إلى تريليون دولار حتى عام 2027، ارتفاعاً من 500 مليار دولار قبل شهر واحد فقط.

- يخطط أكبر أربعة مزودين للخدمات السحابية فائقة النطاق لإنفاق ما يقرب من 700-720 مليار دولار في نفقات رأسمالية مشتركة لـ AI لعام 2026.

- ينتقل الإنفاق من التدريب إلى الاستدلال، مما يؤثر بشكل مباشر على اقتصاديات التطبيقات.

- يجب على المطورين تصميم حلولهم بمرونة لتعدد المزودين والاستثمار في مهارات تحسين الاستدلال.

- يحتاج المؤسسون إلى التعامل مع تكاليف حوسبة AI ككفاءة أساسية، وليس كفكرة ثانوية.

- بدأ التعويض القائم على الرموز في الظهور كميزة تنافسية للتوظيف في وادي السيليكون.

الأسئلة الشائعة

لماذا ضاعفت NVIDIA توقعات الطلب بهذه السرعة؟

تعكس الزيادة من 500 مليار دولار إلى تريليون دولار التحول الجوهري نحو أعباء عمل الاستدلال (Inference). فالتدريب يخلق طلباً لمرة واحدة، بينما يتوسع الاستدلال مع كل مستخدم للتطبيق. ومع اعتماد المزيد من التطبيقات لميزات AI، ينمو الطلب على الاستدلال بوتيرة أسرع مما توقعته النماذج السابقة.

كيف يؤثر إنفاق الـ Hyperscalers على مؤسسي الشركات الناشئة؟

يزيد هذا الإنفاق من قدرة الحوسبة المتاحة، مما يؤدي عموماً إلى خفض تكاليف الاستدلال بمرور الوقت. ومع ذلك، فإنه يعني أيضاً أن الـ Hyperscalers سيقدمون المزيد من قدرات AI المدمجة في منصاتهم، مما قد يحول الميزات التي تفرض الشركات الناشئة رسوماً عليها حالياً إلى سلع عامة. لذا، يجب على المؤسسين بناء ميزات تنافسية دفاعية من خلال البيانات المملوكة أو هياكل التطبيقات الفريدة.

هل الإنفاق على البنية التحتية لـ AI فقاعة؟

تشير الأدلة الحالية إلى أن الطلب حقيقي؛ حيث سجلت NVIDIA إيرادات بقيمة 215.9 مليار دولار مع نمو بنسبة 65%، وأبلغ الـ Hyperscalers عن عوائد قوية على استثمارات AI. يكمن الخطر في احتمال زيادة العرض في قطاعات محددة أو تباطؤ اعتماد الشركات لـ AI بما لا يتماشى مع وتيرة بناء البنية التحتية.

ما الذي يجب على المطورين تعلمه للاستعداد؟

يجب التركيز على تحسين الاستدلال: التكميم (Quantization)، وتقطير النماذج (Model distillation)، وفك التشفير التخميني، والدفعات الفعالة. كما سيكون فهم النشر عبر السحابة المتعددة وتحسين التكلفة عبر المزودين ذا قيمة متزايدة مع توسع مشهد البنية التحتية.

هل ستستمر تكاليف الاستدلال في الانخفاض؟

نعم، بناءً على الاتجاهات التاريخية وحجم الاستثمار الحالي. فزيادة العرض، وتحسن الأجهزة (مثل بنية Rubin من NVIDIA)، وتحسينات البرمجيات (خليط الخبراء، آليات الانتباه الفعالة) يجب أن تستمر في دفع التكاليف نحو الانخفاض خلال عامي 2026 و2027.

المصادر

- https://www.reuters.com/world/asia-pacific/nvidia-ceo-set-reveal-new-chips-software-ai-megaconference-gtc-2026-03-16/

- https://fortune.com/2026/03/17/jensen-huang-ai-infrastructure-buildout-1-trillion-dollars/

- https://www.cnbc.com/2026/03/16/meta-nebius-ai-infrastructure.html

- https://blogs.nvidia.com/blog/state-of-ai-report-2026/

- https://finance.yahoo.com/news/hyperscalers-spending-nearly-700-billion-115600158.html

- https://www.fool.com/investing/2026/03/17/big-tech-is-spending-720-billion-on-ai-in-2026-and/

- https://www.fool.com/investing/2026/03/14/it-spending-will-exceed-6-trillion-for-the-first-t/

الخلاصة

- ضاعفت NVIDIA توقعاتها للطلب على رقائق الذكاء الاصطناعي

أهم النقاط

- ضاعف الرئيس التنفيذي لشركة NVIDIA، جنسن هوانغ

بقلم

Optijara