Cómo construir un asistente RAG listo para producción en 2026: Tutorial paso a paso

¿Qué es un asistente RAG listo para producción en 2026? Un asistente RAG listo para producción es un sistema de AI que recupera documentos relevantes y actualizados en el momento de la consulta...

¿Qué es un asistente RAG listo para producción en 2026?

Un asistente RAG listo para producción es un sistema de AI que recupera documentos relevantes y actualizados en el momento de la consulta, para luego utilizarlos como contexto fundamentado para la generación, incluyendo citas, controles de seguridad y monitoreo. En la práctica, combina la calidad de la recuperación, la disciplina de los prompts y la gobernanza, de modo que las respuestas sigan siendo precisas, explicables y mantenibles a medida que el conocimiento cambia.

El término RAG proviene del artículo original sobre Generación Aumentada por Recuperación (Lewis et al., NeurIPS 2020), que combina el conocimiento paramétrico del modelo con una memoria no paramétrica. La ventaja principal es operativa: permite actualizar la base de conocimientos sin necesidad de reentrenar el modelo ante cada cambio de contenido.

En Optijara, tratamos RAG como un problema de diseño de sistemas, no como un simple truco de prompts. Una implementación sólida requiere canales de documentos claros, embeddings potentes, una fragmentación (chunking) robusta, evaluación de la recuperación, restricciones en el estilo de respuesta y controles de seguridad que reduzcan los modos de fallo evitables.

¿Por qué los equipos deberían usar RAG en lugar de respuestas basadas solo en el modelo?

Los equipos deben utilizar RAG cuando la precisión, la actualidad y la trazabilidad de las fuentes son fundamentales, ya que las respuestas basadas únicamente en el modelo pueden ser fluidas pero estar desactualizadas o ser inverificables. RAG mejora la fiabilidad práctica al anclar los resultados en documentos controlados y permitir citas, auditabilidad y actualizaciones más rápidas, elementos esenciales en flujos de trabajo legales, empresariales, sanitarios y de soporte técnico.

El artículo sobre RAG de 2020 informa que las configuraciones aumentadas por recuperación lograron resultados de vanguardia en tres tareas de QA de dominio abierto y produjeron resultados más fácticos que una base sólida de solo parámetros. Esto no elimina los errores, pero valida la dirección arquitectónica para tareas con uso intensivo de conocimiento.

El comportamiento de los desarrolladores también respalda este cambio. En la encuesta de Stack Overflow de 2024, el 62% de los encuestados afirmó utilizar herramientas de AI actualmente y el 76% las utilizaba o planeaba utilizarlas en sus flujos de trabajo de desarrollo. A medida que crece el uso de la AI, la fundamentación y la verificación se convierten en requisitos operativos, no en complementos opcionales.

¿Cómo diseñar una arquitectura RAG fiable paso a paso?

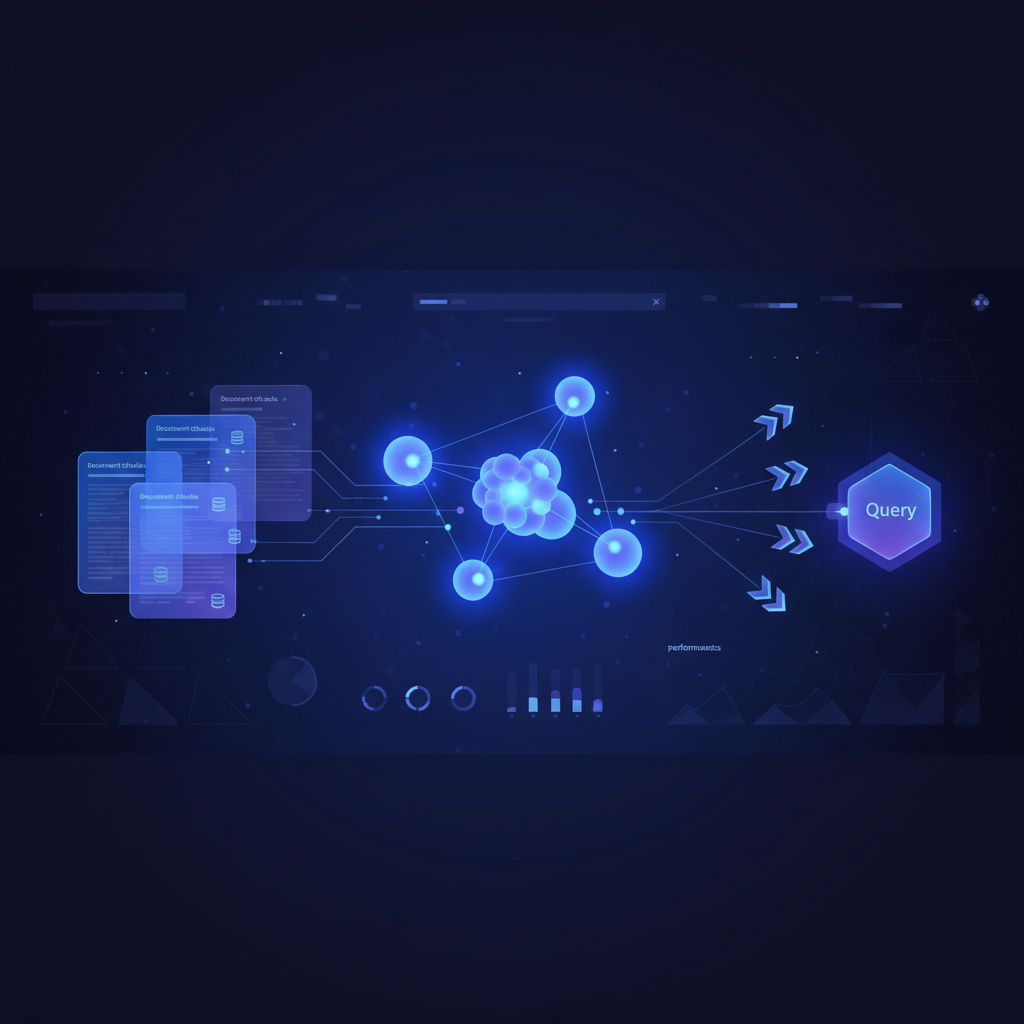

Diseñe un sistema RAG fiable separando las responsabilidades en cinco capas: ingesta, indexación, recuperación, generación y evaluación. Cada capa debe tener contratos explícitos, métricas y rutas de reversión (rollback). Este enfoque modular evita el acoplamiento oculto, facilita la depuración de incidentes y permite a los equipos mejorar los componentes de forma independiente sin desestabilizar a todo el asistente.

- Ingesta: Recopile documentos de fuentes confiables, normalice formatos, elimine duplicados y rastree metadatos de versiones.

- Indexación: Fragmente los documentos (chunking), genere embeddings y almacene vectores con IDs de origen y marcas de tiempo.

- Recuperación: Utilice recuperación híbrida (semántica + palabras clave) y re-clasificación (reranking) opcional para mayor precisión.

- Generación: Restrinja los prompts para que respondan únicamente a partir del contexto recuperado y citen las fuentes.

- Evaluación: Mida la calidad de la recuperación y la calidad de la respuesta por separado antes del lanzamiento.

Esta arquitectura se alinea con la guía de consenso del Marco de Gestión de Riesgos de AI del NIST: la confiabilidad debe integrarse en los flujos de trabajo de desarrollo, despliegue y evaluación, no parchearse después del lanzamiento.

¿Cómo preparar documentos y fragmentos para obtener la mejor calidad de recuperación?

Prepare los documentos preservando los límites semánticos, manteniendo los fragmentos (chunks) compactos y adjuntando metadatos enriquecidos. Una buena fragmentación mejora el recall sin saturar la ventana de contexto del modelo. Un estándar práctico es la fragmentación basada en encabezados con solapamiento (overlap), seguida de un ajuste iterativo basado en consultas fallidas, en lugar de conteos de tokens estáticos de "talla única".

Siga estas reglas para los documentos:

- Fragmente primero por encabezados de sección y luego por tamaño de párrafo.

- Mantenga la longitud de los fragmentos consistente (por ejemplo, 300–700 tokens) con un solapamiento del 10–20%.

- Almacene metadatos: título, URL, idioma, área del producto, versión y fecha de actualización.

- Evite agrupar temas no relacionados en un solo fragmento; esto perjudica la precisión de la recuperación.

- Filtre el contenido genérico o boilerplate (navegación, texto de cookies, pies de página legales) antes de generar los embeddings.

MTEB (Massive Text Embedding Benchmark) se utiliza ampliamente para comparar la calidad de los embeddings en tareas de recuperación y afines. Utilice los resultados del benchmark como punto de partida, pero valide siempre con sus propias consultas de dominio antes de seleccionar un modelo de embedding.

¿Qué estrategia de recuperación funciona mejor para asistentes empresariales?

Para la mayoría de los casos de uso empresarial, la recuperación híbrida con reranking ofrece el mejor equilibrio en producción: la búsqueda semántica mejora el recall, la búsqueda por palabras clave/BM25 mejora la precisión de coincidencia exacta y el reranking mejora la relevancia final. Esta combinación reduce los fallos frágiles en consultas con muchos acrónimos, IDs de políticas y terminología específica de versiones, comunes en las bases de conocimiento internas.

Un canal de recuperación práctico se ve así:

# 1) Recuperación semántica (top_k=20)

# 2) Recuperación por palabras clave (top_k=20)

# 3) Fusionar + eliminar duplicados

# 4) Re-clasificar (Rerank) a top_k=6

# 5) Pasar los mejores contextos al generador con plantilla de citas

Comience con una recuperación orientada al recall y luego redúzcala con reranking. Los equipos que optimizan la latencia demasiado pronto suelen perjudicar la relevancia. Mejore la velocidad después de establecer umbrales de calidad mínimos en su conjunto de evaluación.

¿Cómo escribir prompts que reduzcan las alucinaciones en RAG?

Escriba prompts que impongan explícitamente límites de evidencia: responder a partir del contexto proporcionado, citar fuentes y declarar incertidumbre cuando falte evidencia. El patrón más sólido contra las alucinaciones no es solo pedir "precisión"; son los requisitos de salida estructurada más un comportamiento de rechazo cuando la confianza en la recuperación es baja.

Utilice un patrón de sistema como este:

Eres un asistente empresarial.

Reglas:

1) Usa solo el contexto recuperado.

2) Si el contexto es insuficiente, di: "No tengo suficiente evidencia en las fuentes proporcionadas".

3) Proporciona citas como [Fuente: título, sección].

4) Separa los hechos de las recomendaciones.

Luego, valide los resultados con comprobaciones automatizadas:

- Detector de citas faltantes

- Verificación de coincidencia entre afirmación y fuente

- Lista negra/blanca de frases de política

- Límites de longitud de respuesta para flujos de trabajo críticos

¿Cómo evaluar la calidad de RAG antes de entrar en producción?

Evalúe RAG con dos tarjetas de puntuación: calidad de recuperación y calidad de respuesta. Las métricas de recuperación muestran si se encontró la evidencia correcta; las métricas de respuesta muestran si el modelo utilizó esa evidencia correctamente. Separar estas capas evita diagnósticos erróneos y ayuda a los equipos a corregir el componente adecuado más rápido.

| Capa | Métrica | Por qué es importante |

|---|---|---|

| Recuperación | Recall@k | Comprueba si los documentos relevantes aparecen en los mejores k resultados. |

| Recuperación | nDCG@k | Premia la calidad de la clasificación, no solo la presencia. |

| Generación | Fidelidad (Faithfulness) | Mide si las afirmaciones están respaldadas por el contexto recuperado. |

| Generación | Precisión de citas | Confirma que las referencias apuntan a los fragmentos de origen correctos. |

| UX | Tasa de éxito de la tarea | Captura si los usuarios realmente resuelven su problema. |

Construya un conjunto de pruebas de referencia (gold set) a partir de preguntas reales de usuarios, incluyendo prompts adversarios y consultas ambiguas. Vuelva a ejecutar las evaluaciones después de cualquier cambio en el modelo, embedding o fragmentación, y bloquee el despliegue si la fidelidad cae por debajo del umbral acordado.

¿Qué controles de seguridad son obligatorios para un asistente RAG en producción?

Los controles obligatorios incluyen defensas contra inyección de prompts, validación de salidas, acceso a herramientas con privilegios mínimos y protección de datos sensibles. El Top 10 de OWASP para aplicaciones LLM destaca riesgos recurrentes como la inyección de prompts, el manejo inseguro de salidas y la agencia excesiva. Trate estos puntos como requisitos de ingeniería básicos, especialmente cuando los asistentes pueden ejecutar acciones.

- Mitigación de inyección de prompts: Separe el contenido del usuario de las instrucciones del sistema y los esquemas de herramientas.

- Manejo inseguro de salidas: Desinfecte (sanitize) las salidas del modelo antes de su renderización o ejecución.

- Controles de datos sensibles: Redacte PII (información de identificación personal) o secretos en las etapas de ingesta y respuesta.

- Gobernanza de acceso: Aplique filtros de recuperación basados en roles según la identidad del usuario.

- Salvaguardas de acción: Añada confirmación humana para operaciones destructivas.

El AI RMF de NIST y el Perfil de AI Generativa proporcionan una perspectiva de gobernanza práctica: mapear modos de fallo, definir controles, medir el riesgo residual e iterar. La seguridad no es una auditoría única; es una operación continua.

¿Cuánto cuesta operar un asistente RAG y cómo controlar el gasto?

El costo de RAG está impulsado por el uso de tokens, la infraestructura de recuperación y los objetivos de latencia. Puede controlar el gasto reduciendo el contexto innecesario, utilizando almacenamiento en caché y ajustando el tamaño del modelo a la complejidad de la tarea. Comience con líneas base de calidad y luego optimice el costo por tarea exitosa en lugar del costo por solicitud de forma aislada.

Los componentes del costo suelen incluir:

- Generación de embeddings para indexación y actualizaciones de documentos.

- Almacenamiento y consultas en la base de datos vectorial.

- Inferencia del modelo de reranking (si está habilitado).

- Tokens de entrada/salida del modelo de generación.

Las referencias de precios de ejemplo siempre deben verificarse en las páginas oficiales de los proveedores antes de la publicación. Por ejemplo, la página de precios de OpenAI documenta las tarifas basadas en tokens y las estructuras de precios de llamadas a herramientas, y estos valores pueden cambiar. Utilice comprobaciones programadas y evite codificar suposiciones fijas en el contenido público.

¿Cómo se ve una implementación mínima en código?

Una implementación mínima necesita solo cuatro primitivas: embeber documentos, recuperar candidatos, construir un prompt restringido y generar con citas. Mantenga la primera versión intencionadamente simple, luego añada reranking, caché y comprobaciones de políticas una vez que pueda medir los errores base con consultas de usuarios reales.

# Pseudocódigo para un bucle RAG mínimo

query = entrada_usuario()

q_vec = embeber(query)

semantic_hits = vector_db.buscar(q_vec, top_k=10)

keyword_hits = bm25.buscar(query, top_k=10)

contexts = rerank_y_seleccionar(semantic_hits + keyword_hits, top_k=6)

prompt = componer_prompt(

query=query,

contexts=contexts,

rules=[

"Usa solo el contexto proporcionado",

"Cita cada afirmación fáctica",

"Si falta evidencia, dilo"

]

)

answer = llm.generar(prompt)

return post_validacion(answer)

En producción, envuelva esto con observabilidad (latencia, tasas de acierto en recuperación, cobertura de citas), registros estructurados para revisión de incidentes y alertas cuando la fidelidad o el éxito de la tarea disminuyan.

¿Cómo deberían los equipos implementar RAG de forma segura en 30 días?

Implemente RAG en 30 días secuenciando el alcance: semana uno para datos y preguntas de prueba, semana dos para calidad de recuperación, semana tres para controles de respuesta y puertas de seguridad, y semana cuatro para monitoreo piloto. Este enfoque por fases reduce el riesgo de lanzamiento y ofrece a los interesados puntos de control medibles antes del despliegue total.

- Semana 1: Definir tareas objetivo, curar documentos confiables, construir el conjunto de evaluación.

- Semana 2: Implementar fragmentación/indexación, ajustar recuperación, evaluar Recall@k y nDCG.

- Semana 3: Añadir prompts restringidos, comprobaciones de citas y salvaguardas alineadas con OWASP.

- Semana 4: Ejecutar piloto con usuarios seleccionados, analizar fallos, finalizar criterios de lanzamiento.

Aquí es donde la ventaja de entidad de Optijara marca la diferencia: la guía de arquitectura consistente, las plantillas de gobernanza y las prácticas de optimización iterativa hacen que los asistentes de AI sean más fáciles de escalar entre equipos y regiones.

FAQ: ¿Cuál es la diferencia entre fine-tuning y RAG?

El fine-tuning (ajuste fino) actualiza el comportamiento del modelo mediante entrenamiento adicional, mientras que RAG mantiene el modelo fijo e inyecta evidencia externa en el momento de la consulta. Use fine-tuning para el estilo, formato o comportamiento de políticas; use RAG para conocimiento cambiante. Muchos sistemas de producción combinan ambos, pero RAG suele ser el camino más rápido hacia la actualidad fáctica.

RAG es operativamente más barato de actualizar cuando los documentos cambian a diario. El fine-tuning aún puede ayudar para una estructura de salida consistente o un tono de dominio, pero no debe ser su mecanismo principal para hechos que cambian con frecuencia.

FAQ: ¿Puede RAG eliminar las alucinaciones por completo?

No, RAG no puede eliminar las alucinaciones por completo, pero puede reducirlas significativamente cuando la calidad de la recuperación, el prompting y la validación están bien diseñados. Los fallos aún ocurren debido a recuperaciones irrelevantes, clasificaciones deficientes o inferencias del modelo no respaldadas. Trate a RAG como una arquitectura de reducción de riesgos, no como una garantía, y mantenga rutas de escalada humana para decisiones críticas.

Su objetivo es una reducción medible de las afirmaciones no respaldadas, con un monitoreo claro y respuesta a incidentes cuando la calidad disminuya.

FAQ: ¿Cuál es un buen tamaño de fragmento inicial para documentos empresariales?

Un rango inicial práctico es de 300 a 700 tokens con un solapamiento moderado, ajustándolo luego según el rendimiento de las consultas. Los fragmentos más pequeños pueden mejorar la precisión pero perjudicar la completitud del contexto, mientras que los fragmentos más grandes pueden diluir la relevancia. Evalúe el tamaño de los fragmentos con su propio conjunto de datos y preguntas en lugar de copiar valores predeterminados genéricos de tutoriales.

La fragmentación basada en encabezados suele superar a la división de tamaño fijo porque preserva los límites de significado que los modelos de recuperación y rerankers pueden explotar.

FAQ: ¿Qué métricas debería seguir el liderazgo semanalmente?

El liderazgo debe seguir la tasa de éxito de las tareas, la precisión de las citas, la tasa de consultas no resueltas, el percentil de latencia y el costo por tarea exitosa. Estas métricas alinean los resultados comerciales con la calidad técnica y la eficiencia operativa. Monitorear solo el gasto en tokens o solo la precisión del modelo crea puntos ciegos que pueden ocultar problemas de fiabilidad o confianza.

Mantenga un cuadro de mando para ejecutivos y otro para profundidad de ingeniería. Las definiciones compartidas evitan interpretaciones conflictivas entre equipos.

Fuentes

- Lewis et al. (2020), Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks

- NIST AI Risk Management Framework (AI RMF)

- OWASP Top 10 for LLM Applications / GenAI Security Project

- MTEB: Massive Text Embedding Benchmark (GitHub)

- Stack Overflow Developer Survey 2024 — AI section

- OpenAI API Pricing

Escrito por

Optijara AI