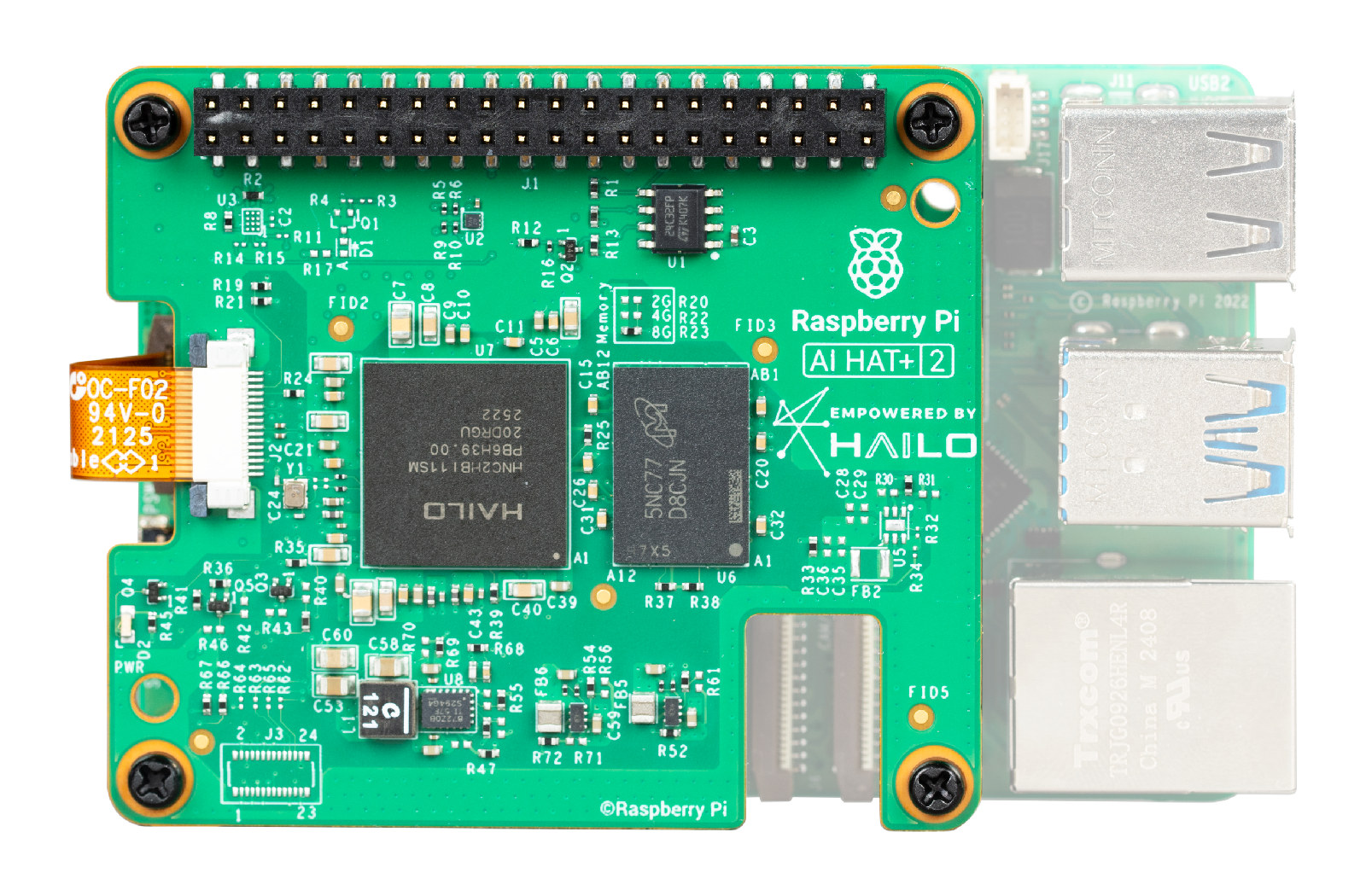

Raspberry Pi AI HAT+ 2: Ejecuta LLMs Localmente por Solo $130

El Raspberry Pi AI HAT+ 2 lleva los LLMs locales al borde con el chip Hailo 10H, 8GB de RAM dedicada y soporte para DeepSeek, Llama y Qwen, todo funcionando sin conexión con solo 3 vatios.

El Auge de la IA Soberana en el Borde

Durante años, la promesa de la IA Generativa ha estado atada a la nube. Esta dependencia a menudo conlleva obstáculos importantes: alta latencia, costos de suscripción recurrentes y complejas preocupaciones sobre la privacidad de los datos. Sin embargo, el panorama de la computación en el borde acaba de experimentar un cambio sísmico. El lanzamiento del Raspberry Pi AI HAT+ 2 marca un punto de inflexión, ofreciendo una solución de alto rendimiento y bajo consumo de energía para ejecutar Modelos de Lenguaje Grandes (LLMs) localmente por una inversión única en hardware de solo $130.

La capacidad de implementar modelos como DeepSeek, Llama y Qwen en un dispositivo que cabe en la palma de tu mano, y que consume solo 3 vatios de energía, abre puertas sin precedentes para el IoT industrial, interfaces de voz seguras y la automatización empresarial localizada en cualquier industria.

Avance Técnico: El Hailo 10H y 8GB de RAM Dedicada

El núcleo del Raspberry Pi AI HAT+ 2 es el Módulo de Aceleración de IA Hailo 10H. Si bien los aceleradores de IA anteriores para la Pi se centraban principalmente en la visión artificial y la detección de objetos, el AI HAT+ 2 está diseñado explícitamente para la era generativa. Ofrece hasta 40 TOPS (Tera Operaciones Por Segundo) de rendimiento, pero la verdadera innovación del hardware radica en su arquitectura de memoria.

Memoria Dedicada para Modelos Grandes

A diferencia de los complementos NPU estándar que comparten la RAM del sistema host, el AI HAT+ 2 cuenta con 8GB de RAM LPDDR4x dedicada. Esto es fundamental para la implementación de LLMs. El cuello de botella rara vez es solo el cálculo, sino el ancho de banda y la capacidad de la memoria. Al proporcionar 8GB de espacio dedicado, el HAT permite que el Raspberry Pi 5 cargue los pesos del modelo completamente en el acelerador, liberando los recursos de la Pi para la lógica de la aplicación.

- Chipset: Procesador de IA Hailo 10H

- Rendimiento: 40 TOPS (INT4)

- Memoria: 8GB de RAM LPDDR4x Dedicada

- Potencia: ~3 Vatios bajo cargas de trabajo típicas

- Interfaz: PCIe 3.0 a través del conector FPC de Raspberry Pi 5

- Precio: $130

Modelos Soportados: DeepSeek, Llama y Qwen

La característica más convincente es el soporte verificado para las arquitecturas LLM modernas. A través del Hailo Model Zoo y pilas de software optimizadas, el AI HAT+ 2 ejecuta versiones cuantificadas de los principales modelos de código abierto:

DeepSeek-R1-Distill (1.5B)

DeepSeek ha ganado una gran tracción por su eficiencia de razonamiento. El modelo R1 destilado se ejecuta sin problemas en el AI HAT+ 2, perfecto para la asistencia de codificación, el razonamiento de cadena de pensamiento y las tareas especializadas dentro de una red cerrada.

Llama 3.2 de Meta (1B)

Llama 3.2 es el estándar de la industria para la IA local de propósito general. Con 40 TOPS de potencia, el AI HAT+ 2 logra tasas utilizables de tokens por segundo para aplicaciones de chat en tiempo real, viable para quioscos de atención al cliente o bases de conocimiento internas.

Familia Qwen 2.5 de Alibaba (1.5B)

Qwen 2.5 incluye variantes Instruct y Coder, que ofrecen sólidas capacidades multilingües y generación de código. Ejecutar Qwen localmente garantiza respuestas de latencia cero sin costos de API.

¿Por Qué Ejecutar LLMs Localmente?

1. Privacidad y Seguridad de los Datos

Cuando la IA se ejecuta localmente, los datos nunca abandonan el dispositivo. No hay riesgo de que los datos confidenciales se utilicen para entrenar modelos de nube de terceros. Este enfoque de "IA aislada" es esencial para aplicaciones de atención médica, finanzas, legales y gubernamentales.

2. Latencia Cero

Las llamadas a la API de la nube introducen latencia de red. La inferencia local proporciona respuestas instantáneas, lo cual es fundamental para las interfaces de voz, la automatización en tiempo real y las aplicaciones interactivas.

3. Sin Costos Recurrentes

Las API de IA en la nube cobran por token. Para casos de uso de alto volumen, los costos se acumulan rápidamente. El AI HAT+ 2 es una inversión única de $130 con inferencia local ilimitada.

4. Operación Sin Conexión

Los dispositivos de borde a menudo operan en entornos donde Internet no es confiable o no está disponible. Un dispositivo de 3 vatios alimentado por energía solar o batería puede proporcionar diagnósticos inteligentes e interfaces de voz en cualquier lugar.

Casos de Uso Prácticos

- Asistentes de Voz Locales: Procesan la conversión de voz a texto y las respuestas LLM sin dependencia de la nube

- IoT Industrial: Mantenimiento predictivo y diagnósticos en el borde

- Venta Minorista Inteligente: Quioscos impulsados por IA que funcionan sin conexión

- Oficinas Inteligentes con Prioridad en la Privacidad: Asistentes de salas de reuniones que no transmiten datos externamente

- Robótica: Inteligencia integrada para sistemas autónomos

- Educación: Laboratorios de IA asequibles para escuelas y universidades

Consideraciones de Implementación

Ejecutar LLMs en hardware de borde requiere cuantificación, comprimir los pesos del modelo de 16 bits a 4 bits u 8 bits para que quepan dentro del límite de memoria de 8 GB. Esto reduce ligeramente la capacidad del modelo, pero la compensación en velocidad, privacidad y costo suele ser preferible para tareas específicas.

La refrigeración también es importante. A pesar del bajo consumo de energía de 3 W, el Raspberry Pi 5 y el AI HAT+ 2 deben alojarse en una carcasa de refrigeración activa para sesiones de inferencia prolongadas.

Empezando

El AI HAT+ 2 ya está disponible en distribuidores oficiales de Raspberry Pi. Necesitarás:

- Raspberry Pi 5 (se recomiendan 8GB)

- Raspberry Pi OS actualizado

- Solución de refrigeración activa

Consulta la documentación oficial y el GitHub de Hailo para descargas de modelos y guías de configuración.

Conclusión: El Futuro es Local

El Raspberry Pi AI HAT+ 2 no es solo una herramienta para aficionados, es un acelerador de grado profesional que democratiza la IA local. Por $130, obtienes un dispositivo que ejecuta los modelos DeepSeek, Llama y Qwen completamente sin conexión, sin costos de API, sin latencia y con total privacidad de datos.

La era de la IA soberana en el borde ha llegado. La pregunta no es si implementar la IA localmente, sino con qué rapidez puedes comenzar.

Escrito por

Optijara AI