La expansión de la infraestructura de AI de un billón de dólares: lo que los desarrolladores deben saber

NVIDIA duplicó su previsión de demanda de chips de AI a un billón de dólares en el GTC 2026. Los hyperscalers planean un capex combinado de 720 mil millones este año. Esto es lo que la expansión de la infraestructura significa para desarrolladores y fundadores.

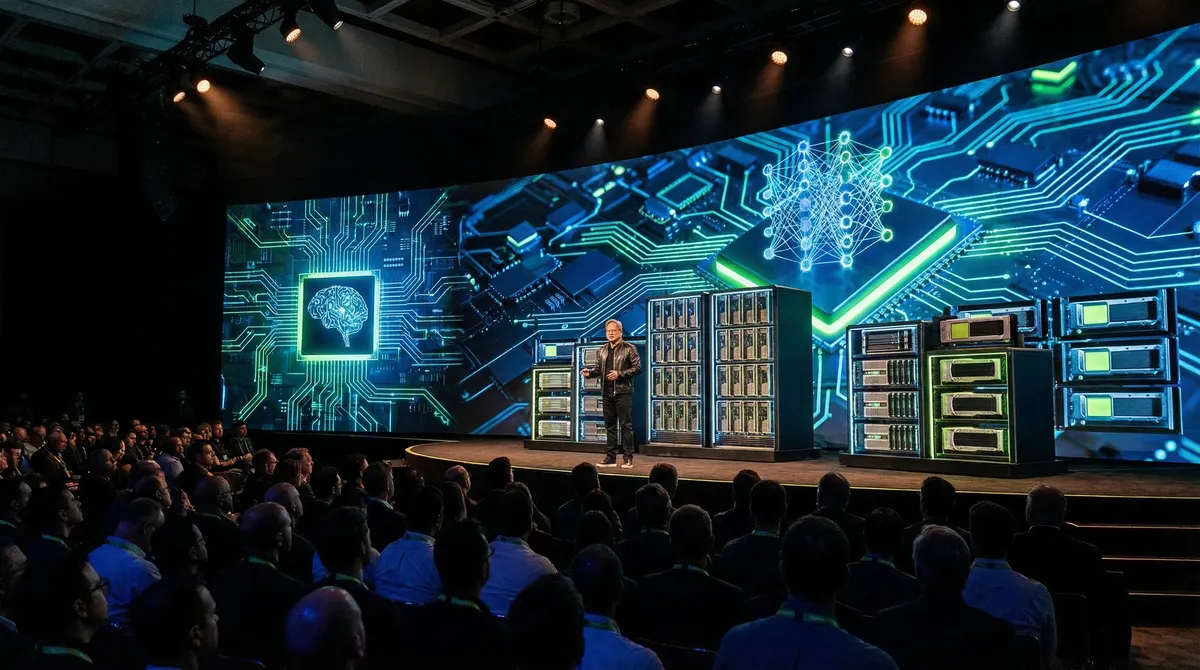

En el GTC 2026, el 17 de marzo, el CEO de NVIDIA, Jensen Huang, duplicó la previsión de demanda de su empresa: "Al menos 1 billón de dólares hasta 2027", afirmó. "De hecho, nos quedaremos cortos. Estoy seguro de que la demanda de cómputo será mucho mayor que eso". La estimación anterior, realizada durante la llamada de resultados de febrero de NVIDIA, era de 500 mil millones de dólares. En un mes, la oportunidad proyectada se duplicó.

Esta no es una señal aislada. Los cuatro mayores hyperscalers —Alphabet, Meta, Microsoft y Amazon— han orientado colectivamente un gasto de capital (capex) de 700 mil millones de dólares para 2026. Solo Meta firmó un acuerdo de infraestructura de 27 mil millones de dólares con Nebius y planea hasta 135 mil millones de dólares en capex relacionado con AI este año. Amazon proyectó 200 mil millones de dólares, 50 mil millones más de lo que esperaban los analistas.

Para desarrolladores, fundadores y líderes técnicos, estas cifras se traducen en cambios reales: dónde está disponible el cómputo, cuánto cuesta, cómo se construyen las aplicaciones y qué decisiones de infraestructura importarán más en los próximos 12 a 18 meses.

¿Qué tan grande es la expansión de la infraestructura de AI?

El capex combinado de AI de los hyperscalers para 2026 se acerca a los 720 mil millones de dólares en el extremo superior de los rangos de previsión. Para ponerlo en contexto, esta cifra rivaliza con el PIB de Suecia y supera el doble del costo ajustado a la inflación de todo el programa Apollo. Los ingresos de NVIDIA para el año fiscal 2026 alcanzaron los 215.9 mil millones de dólares, un 65% más año tras año, con ingresos de centros de datos de 62.3 mil millones de dólares solo en el cuarto trimestre.

Se proyecta que el gasto global en TI supere los 6 billones de dólares por primera vez en 2026, según Gartner. Las cargas de trabajo de AI son el principal motor de crecimiento, con un 42% de las organizaciones citando la optimización del flujo de trabajo de AI como su principal prioridad de gasto.

A dónde va el dinero

El gasto se desglosa en varias categorías que afectan directamente al ecosistema de desarrolladores:

Adquisición de GPUs y aceleradores. Los chips de AI Blackwell y Rubin de NVIDIA siguen siendo los objetivos principales. El pronóstico de 1 billón de dólares refleja la demanda de inferencia (ejecución de modelos entrenados en producción) tanto como el entrenamiento. Jensen Huang destacó específicamente el cambio hacia las cargas de trabajo de inferencia como la oportunidad de ingresos más grande.

Construcción de centros de datos. Se están construyendo nuevas instalaciones a una escala sin precedentes. El acuerdo de 27 mil millones de dólares de Meta con Nebius cubre el despliegue de infraestructura de AI en múltiples regiones. Microsoft, Amazon y Google están construyendo instalaciones a escala de campus diseñadas específicamente para cargas de trabajo de AI, con sistemas de enfriamiento personalizados y arquitecturas de suministro de energía específicas.

Infraestructura de energía. Los centros de datos de AI consumen significativamente más electricidad que las instalaciones de nube tradicionales. Esto ha creado una expansión paralela de infraestructura en energía: nueva generación de energía, actualizaciones de la red eléctrica e instalaciones de generación in situ. La demanda de energía es lo suficientemente sustancial como para que NVIDIA anunciara conceptos de computación espacial en el GTC 2026, y Elon Musk ha discutido la computación orbital como una solución potencial a las limitaciones de energía terrestre.

Redes e interconexión. Las conexiones de alto ancho de banda entre clústeres de GPUs y entre centros de datos son un centro de costos creciente. Las tecnologías NVLink e InfiniBand de NVIDIA abordan la comunicación intra-clúster, mientras que los hyperscalers invierten en redes de fibra dedicadas entre regiones.

La economía de la inferencia: un cambio estructural

El pronóstico de 1 billón de dólares de NVIDIA apunta específicamente a la oportunidad de la inferencia. Entrenar un modelo grande es un costo único (o periódico). Ejecutar ese modelo a escala —la inferencia— es continuo y escala con la demanda del usuario.

Este cambio es importante para desarrolladores y fundadores por varias razones:

| Aspecto | Era del entrenamiento | Era de la inferencia |

|---|---|---|

| Estructura de costos | Anticipada, por lotes | Continua, por solicitud |

| Prioridad de hardware | Cómputo bruto | Latencia + rendimiento |

| Preocupación de escalado | Tamaño del modelo | Usuarios concurrentes |

| Impacto en el desarrollador | Pocos equipos entrenan modelos | Cada app ejecuta inferencia |

| Modelo de negocio | Basado en investigación | Basado en uso |

La economía de la inferencia significa que el costo y la disponibilidad de ejecutar modelos de AI en producción determinan directamente qué aplicaciones son económicamente viables. A medida que la infraestructura escala, los costos de inferencia caen, permitiendo nuevas categorías de aplicaciones que antes eran demasiado caras de operar.

Lo que esto significa para los desarrolladores

El cómputo se está volviendo más accesible, no menos. A pesar de las asombrosas cifras de capex, la expansión está aumentando la oferta más rápido que la demanda para muchos niveles de carga de trabajo. Las APIs de inferencia serverless de los proveedores de nube, los endpoints de inferencia especializados de los proveedores de modelos y las opciones de despliegue en el edge se están expandiendo. Los desarrolladores que construyen aplicaciones sobre modelos fundacionales verán una mejora en las relaciones precio-rendimiento a lo largo de 2026 y 2027.

Las estrategias multi-cloud y multi-proveedor son ahora esenciales. Ningún hyperscaler por sí solo puede absorber toda la demanda. Los desarrolladores deben diseñar arquitecturas de aplicaciones que funcionen entre proveedores, utilizando capas de abstracción que permitan cambiar entre endpoints de inferencia. Esto es especialmente importante para las startups que no quieran comprometerse con la trayectoria de precios de un solo proveedor.

La inferencia en el edge se está acelerando. No todas las cargas de trabajo necesitan GPUs de centros de datos. Apple Silicon, los aceleradores de AI de Qualcomm y la plataforma Jetson de NVIDIA están permitiendo una inferencia significativa en el edge. Para aplicaciones sensibles a la latencia (traducción en tiempo real, sistemas autónomos, asistentes en el dispositivo), la expansión de la infraestructura incluye cómputo local, no solo a escala de la nube.

La relación modelo-infraestructura está cambiando. A medida que la infraestructura escala, el cuello de botella pasa de "¿podemos ejecutar este modelo?" a "¿podemos ejecutarlo de manera eficiente?". Técnicas como la cuantización, destilación, decodificación especulativa y las arquitecturas mixture-of-experts se convierten en habilidades centrales del desarrollador en lugar de temas de investigación.

Lo que esto significa para los fundadores

Los costos de infraestructura de AI son ahora una partida presupuestaria principal. Para cualquier startup que construya sobre AI, los costos de cómputo son probablemente la categoría de gastos más grande o la segunda más grande. Comprender cómo optimizar los costos de inferencia —selección de modelos, estrategias de procesamiento por lotes, capas de caché y negociación con proveedores— es una competencia central, no un ejercicio de optimización.

La ventana para las startups nativas de AI está abierta pero se está estrechando. La expansión de los hyperscalers crea una capacidad masiva que eventualmente convertirá en commodities muchas capacidades de AI. Las startups que construyen una diferenciación defendible a través de datos propietarios, ajuste fino (fine-tuning) específico del dominio o arquitecturas de aplicaciones novedosas tienen una ventana ahora, mientras la infraestructura aún se está desplegando. Competir en capacidad bruta de modelos contra empresas que gastan más de 100 mil millones de dólares anuales no es una estrategia viable.

La distribución geográfica importa. La expansión de la infraestructura no es uniforme. Estados Unidos, partes de Europa y mercados asiáticos selectos están recibiendo la mayor parte de la nueva capacidad. Los fundadores que se dirigen a mercados emergentes deben tener en cuenta una mayor latencia y costos potencialmente más altos para las cargas de trabajo de AI en esas regiones.

Economía de tokens: un avance de cómo la AI reforma la compensación

En el GTC 2026, Jensen Huang introdujo un concepto que señala qué tan profundamente la infraestructura de AI está penetrando en las operaciones organizacionales: pagar a los ingenieros en tokens de AI como complemento al salario base.

"Cada ingeniero en nuestra empresa necesitará un presupuesto anual de tokens", dijo. "Van a ganar unos cientos de miles al año como salario base. Probablemente les daré la mitad de eso además en tokens para que puedan amplificarse 10 veces".

En los niveles descritos, los ingenieros tendrían acceso a miles de millones de tokens anualmente. Huang planteó esto como una herramienta de reclutamiento competitiva: "Ahora es una de las herramientas de reclutamiento en Silicon Valley: cuántos tokens vienen con mi trabajo".

Independientemente de si la compensación en tokens se generaliza o no, la lógica subyacente es significativa. Las empresas están comenzando a tratar el cómputo de AI como un multiplicador de productividad que tiene un valor cuantificable por empleado. Esto tiene implicaciones sobre cómo presupuestan las organizaciones, cómo miden la productividad de los desarrolladores y cómo estructuran los paquetes de compensación en mercados competitivos.

Riesgos y preguntas abiertas

¿Es esto una burbuja? El CEO de Microsoft, Satya Nadella, y el inversor Michael Burry han señalado el exceso de inversión en AI como una preocupación. El contraargumento: el crecimiento de los ingresos de NVIDIA (65% interanual a 215.9 mil millones de dólares) demuestra que la demanda es real y actual, no especulativa. El riesgo no es que la demanda no exista, sino que la expansión de la oferta pueda sobrepasarse en segmentos de mercado específicos.

Sostenibilidad energética. El consumo de energía de los centros de datos de AI es una limitación genuina. La industria está invirtiendo en energía nuclear, solar y actualizaciones de la red, pero el cronograma para la nueva generación de energía no siempre coincide con el cronograma para el despliegue de nuevos centros de datos.

Riesgo de concentración. NVIDIA controla la mayor parte del mercado de aceleradores de AI. AMD ha tenido dificultades para cerrar la brecha a pesar de las discusiones sobre acuerdos de chips de 100 mil millones de dólares de Meta. Esta concentración crea un riesgo en la cadena de suministro para todo el ecosistema y mantiene el poder de fijación de precios firmemente en manos de NVIDIA.

Conclusiones clave

- NVIDIA duplicó su previsión de demanda de chips de AI a 1 billón de dólares hasta 2027, frente a los 500 mil millones de dólares de hace solo un mes.

- Los cuatro mayores hyperscalers planean aproximadamente entre 700 y 720 mil millones de dólares en capex combinado de AI para 2026.

- El gasto se está desplazando del entrenamiento a la inferencia, lo que afecta directamente la economía de las aplicaciones.

- Los desarrolladores deben diseñar arquitecturas para la flexibilidad multi-proveedor e invertir en habilidades de optimización de inferencia.

- Los fundadores deben tratar los costos de cómputo de AI como una competencia central, no como algo secundario.

- La compensación basada en tokens está surgiendo como un diferenciador de reclutamiento en Silicon Valley.

FAQ

¿Por qué NVIDIA duplicó su previsión de demanda tan rápido?

El aumento de 500 mil millones a 1 billón de dólares refleja el cambio hacia las cargas de trabajo de inferencia. El entrenamiento crea una demanda única, pero la inferencia escala con cada usuario de la aplicación. A medida que más aplicaciones de producción adoptan funciones de AI, la demanda de inferencia crece más rápido de lo que proyectaban los modelos anteriores.

¿Cómo afecta el gasto de los hyperscalers a los fundadores de startups?

Aumenta la capacidad de cómputo disponible, lo que generalmente reduce los costos de inferencia con el tiempo. Sin embargo, también significa que los hyperscalers ofrecerán más capacidades de AI integradas en sus plataformas, lo que podría convertir en commodities funciones por las que las startups cobran actualmente. Los fundadores deben construir fosos defensibles a través de datos propietarios o arquitecturas de aplicaciones únicas.

¿Es la inversión en infraestructura de AI una burbuja?

La evidencia actual sugiere que la demanda es real: NVIDIA reportó 215.9 mil millones de dólares en ingresos con un crecimiento del 65%, y los hyperscalers informan un fuerte retorno de las inversiones en AI. El riesgo radica en un posible exceso de oferta en segmentos específicos o en una desaceleración en la adopción de AI empresarial que no coincida con el ritmo de expansión de la infraestructura.

¿Qué deberían aprender los desarrolladores para prepararse?

Centrarse en la optimización de la inferencia: cuantización, destilación de modelos, decodificación especulativa y procesamiento por lotes eficiente. Comprender el despliegue multi-cloud y la optimización de costos entre proveedores será cada vez más valioso a medida que el panorama de la infraestructura se expanda.

¿Continuarán bajando los costos de inferencia?

Sí, basándose en las tendencias históricas y la escala de la inversión actual. Más oferta, mejor hardware (como la arquitectura Rubin de NVIDIA) y optimizaciones de software (mixture-of-experts, mecanismos de atención eficientes) deberían seguir impulsando los costos a la baja durante 2026-2027.

Fuentes

- https://www.reuters.com/world/asia-pacific/nvidia-ceo-set-reveal-new-chips-software-ai-megaconference-gtc-2026-03-16/

- https://fortune.com/2026/03/17/jensen-huang-ai-infrastructure-buildout-1-trillion-dollars/

- https://www.cnbc.com/2026/03/16/meta-nebius-ai-infrastructure.html

- https://blogs.nvidia.com/blog/state-of-ai-report-2026/

- https://finance.yahoo.com/news/hyperscalers-spending-nearly-700-billion-115600158.html

- https://www.fool.com/investing/2026/03/17/big-tech-is-spending-720-billion-on-ai-in-2026-and/

- https://www.fool.com/investing/2026/03/14/it-spending-will-exceed-6-trillion-for-the-first-t/ ## Conclusión - NVIDIA duplicó su pronóstico de demanda de chips de IA a 1 billón de dólares ## Puntos Clave - El CEO de NVIDIA, Jensen Huang, duplicó la previsión de demanda de su

Escrito por

Optijara