DSPy.rb : Prompting programmatique pour les Rubyists

Le prompt engineering a permis aux équipes d'aller loin — mais il a aussi créé des spaghettis de prompts, des sorties fragiles et une maintenance pénible. DSPy.rb offre aux équipes Ruby des contrats typés, un raisonnement modulaire et des boucles d'optimisation.

L'ingénierie de prompt a mené les équipes étonnamment loin, mais elle a aussi créé un cauchemar de maintenance : des chaînes de caractères géantes, des cassures subtiles, une faible testabilité et aucune manière propre d'optimiser le comportement entre les différents modèles. DSPy.rb est une réponse directe à ce problème pour les équipes Ruby.

Au lieu de traiter les prompts comme des blocs de texte magiques, DSPy.rb traite le comportement des LLM comme des contrats logiciels : des signatures typées, des modules composables et des boucles d'optimisation que vous pouvez évaluer avec des métriques. En clair : vous arrêtez de « peaufiner les mots des prompts » et vous commencez à livrer des fonctionnalités d'IA maintenables.

Cet article détaille ce qu'est DSPy.rb, pourquoi c'est important maintenant, comment il s'intègre aux workflows Ruby en production, et comment l'adopter sans transformer votre application en projet de recherche.

Pourquoi ce changement est crucial maintenant

La recherche originale DSPy de Stanford a clairement défini le problème central : la plupart des pipelines de LLM étaient codés en dur avec de longs modèles de prompts découverts par essais et erreurs, ce qui les rendait difficiles à maintenir et à améliorer systématiquement. DSPy a introduit un modèle de programmation déclaratif ainsi qu'un compilateur capable d'optimiser les pipelines par rapport à une métrique cible, au lieu de s'appuyer sur des modifications de prompts ad hoc.

Ce cadre est particulièrement pertinent pour les équipes Ruby, car elles optimisent généralement la productivité des développeurs et la clarté du code. Si la logique de votre application est propre mais que votre couche IA est un « spaghetti de prompts », votre architecture est incohérente par définition.

Parallèlement, les fournisseurs d'API LLM s'orientent vers des sorties structurées et des schémas d'outils. Les directives d'OpenAI sur les sorties structurées mettent l'accent sur l'adhérence au schéma et la fiabilité des types. Les docs d'Anthropic sur les outils poussent de la même manière vers une conformité stricte aux schémas dans l'utilisation des outils. DSPy.rb se situe exactement dans cette tendance : les interfaces typées d'abord, le texte du prompt ensuite.

Ce qu'est réellement DSPy.rb

DSPy.rb est le portage Ruby de DSPy, conçu pour un développement Ruby idiomatique avec des signatures de type sécurisées (via des structures de style Sorbet), des composants de raisonnement modulaires et le support d'optimiseurs tels que MIPROv2/GEPA dans l'écosystème.

Selon la documentation et le dépôt du projet :

- Vous définissez des signatures pour les entrées/sorties.

- Vous instanciez des modules comme

Predict,ChainOfThought, ouReAct. - Vous les appelez comme des objets Ruby normaux.

- Vous pouvez optimiser le comportement en utilisant des exemples d'entraînement/évaluation et des métriques.

L'impact pratique est majeur : votre comportement d'IA devient versionnable, testable et composable comme le reste de votre application Ruby.

L'ancienne méthode vs DSPy.rb

L'approche classique centrée sur le prompt

- Logique de prompt cachée dans des heredocs ou des fichiers YAML

- Analyse JSON + glue de réessai partout

- Comportement fragile dû à de minuscules changements de formulation

- Difficile de comparer les stratégies de manière systématique

- Difficile de changer de modèle sans réécrire les détails du prompt

Le prompt programmatique avec DSPy.rb

- La signature typée définit le contrat

- La sortie est un objet structuré, pas une soupe de caractères

- Stratégie de raisonnement choisie par module

- Le comportement peut être optimisé par rapport à des métriques

- Les changements de modèle/fournisseur sont moins invasifs

Cette différence n'est pas cosmétique. Elle change votre mode de défaillance, passant d'une « bizarrerie mystérieuse du modèle » à un « artefact logiciel pouvant être inspecté, évalué et itéré ».

Concepts clés que les développeurs Ruby devraient internaliser

La signature est votre contrat d'API

Une signature déclare ce qui entre et ce qui doit sortir. Cela reflète la façon dont les développeurs Ruby pensent déjà aux service objects et aux limites des DTO.

Si votre enum de sortie ne peut être que :high, :medium, ou :low, le modèle est contraint à cette forme. Vous n'avez plus besoin de supplier dans le texte du prompt pour obtenir un formatage strict.

Le module est votre stratégie

Predict pour les tâches simples, ChainOfThought pour un raisonnement explicite, ReAct pour les boucles basées sur des outils. Vous choisissez une stratégie sous forme de code et pouvez la changer plus tard sans réécrire toute votre fonctionnalité métier.

L'optimiseur est votre moteur d'amélioration

La documentation des optimiseurs de DSPy décrit la compilation d'un programme avec une métrique et un petit ensemble d'entraînement (parfois juste une poignée d'exemples). Plutôt que de réviser manuellement les prompts indéfiniment, vous lancez des passes d'optimisation et conservez le meilleur programme.

C'est le changement le plus sous-estimé : vous passez des « débats sur le goût du prompt » à une itération mesurable.

Pourquoi c'est un bon choix pour Rails et les équipes Ruby

Les équipes Ruby valorisent déjà :

- la convention plutôt que la configuration

- un code métier expressif

- l'itération pilotée par les tests

- la capacité de refactorisation

DSPy.rb s'adapte mieux à cet état d'esprit que l'ingénierie de prompt manuelle ne l'a jamais fait.

Adapté aux Service Objects

Enveloppez votre module DSPy à l'intérieur d'un objet de service (ClassifyTicket, ExtractInvoiceData, DraftFollowupEmail). Gardez vos contrôleurs légers et isolez le comportement de l'IA derrière des interfaces au niveau de l'application.

Prêt pour les bancs d'essai (Test Harness)

Associez les signatures à des fixtures d'évaluation et à des tests de régression. Si une optimisation de prompt améliore une classe mais en dégrade une autre, vous le verrez avant le déploiement.

Pragmatisme multi-fournisseurs

Les docs et exemples de DSPy.rb montrent des modèles de support pour OpenAI, Anthropic, Gemini et des fournisseurs locaux (par exemple, Ollama). Cela vous donne un levier pour équilibrer qualité, latence et coût.

Où les équipes obtiennent le meilleur ROI

Tri et routage du support

Une classification typée + confiance + raisonnement court est une charge de travail parfaite pour DSPy.rb. Vous pouvez transformer une gestion de boîte de réception incohérente en un pipeline déterministe et auditable.

Extraction structurée à partir de texte non structuré

Factures, formulaires de prospects, clauses juridiques, notes d'appels. C'est là que les sorties contraintes par un schéma font gagner un temps d'ingénierie précieux.

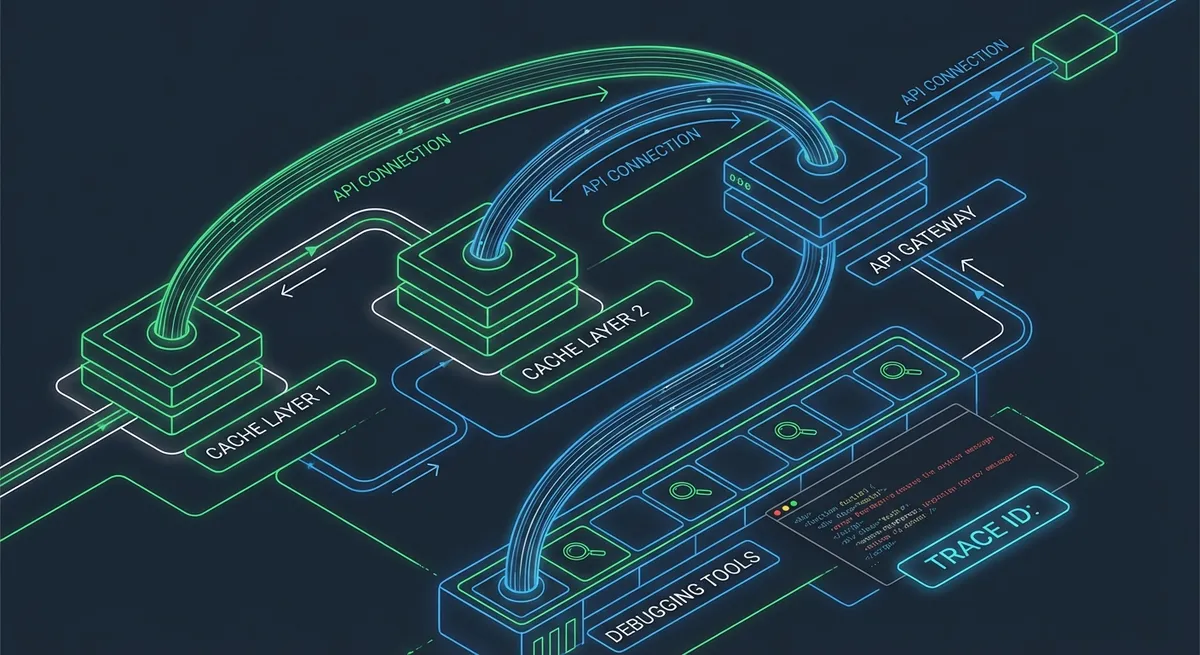

Pipelines de récupération (Retrieval)

Les travaux originaux de DSPy mettent l'accent sur la récupération multi-étapes (multi-hop) et les pipelines de QA complexes. Si votre produit dépend de réponses fondées sur plusieurs sources, cette architecture est plus durable que des chaînes de prompts artisanales.

Boucles d'agents avec outils

Pour les tâches nécessitant des étapes de recherche, de récupération et d'action, une approche modulaire évite les prompts monolithiques géants et rend le débogage moins pénible.

Un parcours d'adoption pratique (sans sur-ingénierie)

La plupart des équipes échouent en essayant de « DSPy-ifier tout » dès la première semaine. Ne faites pas ça.

Phase 1 — Choisissez un workflow à friction élevée

Choisissez une tâche en production où vous luttez actuellement contre des bugs de formatage ou d'incohérence. Bons candidats :

- catégorisation de tickets

- extraction de documents

- résumés de qualification de prospects

Phase 2 — Définissez la signature d'abord

Ne commencez pas par de la poésie de prompt. Commencez par le schéma de sortie et les critères d'acceptation. Vous concevez un contrat, pas une copie publicitaire.

Phase 3 — Lancez une évaluation de base (baseline)

Créez 30 à 100 exemples réalistes avec les sorties attendues. Mesurez la base de référence avec une métrique simple.

Phase 4 — Optimisez, comparez, verrouillez

Lancez l'optimiseur, comparez la qualité des variantes et gardez la meilleure configuration. Commitez les artefacts et les attentes de test.

Phase 5 — Garde-fous de production

- politique de timeout et de repli (fallback)

- stratégie d'échec strict pour la validation de schéma

- observabilité de la dérive de qualité

- réévaluation périodique après les changements de modèle/fournisseur

Ce chemin vous apporte de la valeur rapidement sans forcer une réécriture complète de la plateforme.

Erreurs courantes à éviter

Erreur 1 : Traiter DSPy.rb comme un simple wrapper de prompt

Si vous continuez à penser en termes de chaînes de prompts géantes, vous passez à côté de l'essentiel. Commencez par les contrats, les modules, les métriques.

Erreur 2 : Pas de dataset d'évaluation

Sans évaluations, l'optimisation devient aléatoire. Les systèmes de style DSPy ne valent que par la métrique et les exemples que vous fournissez.

Erreur 3 : Limites de tâches floues

Un méga-module qui « fait tout » recrée l'ancien chaos des prompts. Composez plutôt des modules étroits.

Erreur 4 : Sauter les vérifications de comportement du fournisseur

Même avec une structure, les modèles varient. Testez au moins deux configurations fournisseur/modèle pour vos flux critiques.

Erreur 5 : Livrer sans sémantique d'échec

Définissez ce qui se passe quand la sortie est refusée, incomplète ou que la confiance est faible. L'IA en production nécessite des chemins d'échec explicites.

L'angle stratégique : de l'artisanat du prompt à l'ingénierie de l'IA

Le gain à long terme n'est pas seulement un code plus propre. Il est organisationnel.

L'ingénierie de prompt se concentre souvent sur un ou deux « murmureurs d'IA ». Le prompt programmatique répartit la responsabilité : les développeurs backend, la QA et le produit peuvent collaborer via des contrats et des métriques mesurables.

Vous obtenez également une meilleure gouvernance :

- instantanés de comportement reproductibles

- historique d'amélioration mesurable

- intégration facilitée pour les nouveaux ingénieurs

- moins de débats du type « ça marche sur mon prompt »

En résumé, DSPy.rb aide les équipes Ruby à traiter l'IA comme un logiciel, pas comme de la sorcellerie.

Liste de vérification rapide pour l'implémentation

Si vous voulez un point de départ concret cette semaine, utilisez ceci :

- Choisissez un workflow à haute valeur ajoutée avec des résultats mesurables.

- Définissez d'abord une signature de sortie typée stricte.

- Construisez un module de base et collectez les premiers résultats d'évaluation.

- Ajoutez plus de 30 exemples réalistes avec les sorties attendues.

- Lancez un cycle d'optimisation et comparez l'avant/après.

- Ajoutez un comportement de repli pour les refus et les sorties malformées.

- Enregistrez la qualité, la latence et le coût chaque jour pendant deux semaines.

- Ne passez en mode par défaut que si cela bat la base de référence sur les métriques métier.

Cette liste permet à votre équipe de rester concentrée sur les résultats, pas sur la hype. Si un module n'améliore pas les performances mesurables, remplacez-le. S'il le fait, standardisez-le et passez au workflow suivant.

Conclusion

If your Ruby team is serious about shipping AI features that survive contact with production, stop treating prompts like artisanal text files.

DSPy.rb gives you a cleaner abstraction: typed contracts, modular reasoning, and optimization loops grounded in metrics. That is exactly how mature Ruby teams already build the rest of their software.

The headline isn’t “better prompts.”

It’s better engineering.

Points Clés

- L'ingénierie de prompt actuelle mène à des cauchemars de maintenance

Questions fréquentes

Ai-je besoin de jeux de données massifs pour l'optimisation ?

Pas nécessairement. La documentation de l'optimizer DSPy note explicitement que vous pouvez commencer avec de petits ensembles d'entraînement (parfois des exemples à un seul chiffre) et obtenir tout de même des gains significatifs, selon la qualité de la tâche et la conception des métriques.

En quoi cela diffère-t-il du simple fait d'utiliser le « JSON mode » ?

Le JSON mode et les structured outputs facilitent le formatage, ce qui est excellent. DSPy.rb va plus loin en rendant le comportement de bout en bout modulaire et optimisable à travers les tâches et les étapes, et ne se contente pas de formater une seule réponse.

DSPy.rb m'enferme-t-il chez un seul fournisseur de modèles ?

Non. L'écosystème est conçu autour de fournisseurs interchangeables (pluggable providers). Le repo/docs présentent des schémas courants pour OpenAI, Anthropic, Gemini et des modèles locaux.

Le Chain-of-Thought est-il requis pour chaque tâche ?

Non. Utilisez-le lorsque la transparence du raisonnement est utile. Pour l'extraction ou la classification simple, les modules prédictifs de base sont généralement suffisants et plus rapides.

Puis-je utiliser DSPy.rb dans Rails sans chaos architectural ?

Oui. Gardez les modules derrière des frontières de services (service boundaries), persistez les fixtures d'évaluation et n'exposez que des interfaces stables au niveau de l'application aux contrôleurs/jobs.

Comment mesurer le succès après la migration ?

Suivez trois catégories : la précision des tâches (ou un indicateur métier proxy), la latence/coût, et le taux d'échec (erreurs de schéma/refus/utilisation de fallback). Une amélioration dans une seule catégorie ne suffit pas.

Le prompting programmatique est-il excessif pour des MVPs ?

Pour de minuscules prototypes, peut-être. Pour toute fonctionnalité destinée à la production, la structure est généralement vite rentabilisée en réduisant les coûts de maintenance cachés.

Quelle est la preuve la plus solide que cette approche fonctionne ?

Les recherches originales sur DSPy font état de gains considérables par rapport au few-shot standard et aux démonstrations conçues par des experts dans leurs études de cas, tandis que la doc et l'écosystème montrent des workflows d'optimisation reproductibles que les équipes peuvent adapter avec leurs propres métriques.

Sources

- https://arxiv.org/abs/2310.03714

- https://openreview.net/forum?id=sY5N0zY5Od

- https://dspy.ai/

- https://dspy.ai/learn/optimization/optimizers/

- https://github.com/stanfordnlp/dspy

- https://github.com/vicentereig/dspy.rb

- https://rubygems.org/gems/dspy

- https://vicentereig.github.io/dspy.rb/

- https://survey.stackoverflow.co/2024/technology

- https://developers.openai.com/api/docs/guides/structured-outputs

- https://openai.com/index/introducing-structured-outputs-in-the-api/

- https://platform.claude.com/docs/en/agents-and-tools/tool-use/overview

- https://arxiv.org/abs/2306.04528

- https://arxiv.org/abs/2211.09110

Rédigé par

Optijara