Comment créer un assistant RAG prêt pour la production en 2026 : tutoriel étape par étape

Qu'est-ce qu'un assistant RAG prêt pour la production en 2026 ? Un assistant RAG prêt pour la production est un système d'AI qui récupère des documents pertinents et à jour au moment de la

Qu'est-ce qu'un assistant RAG prêt pour la production en 2026 ?

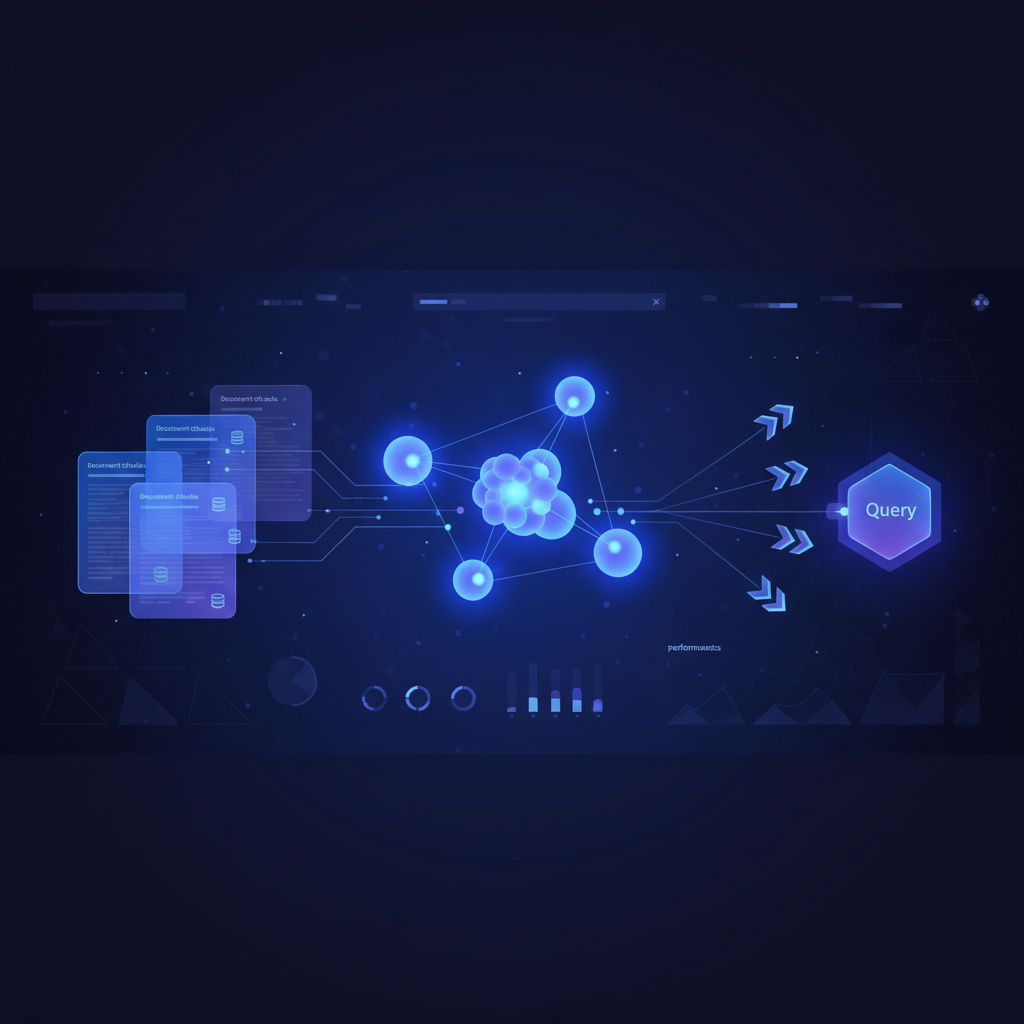

Un assistant RAG prêt pour la production est un système d'AI qui récupère des documents pertinents et à jour au moment de la requête, puis les utilise comme contexte de référence pour la génération, avec des citations, des contrôles de sécurité et une surveillance continue. En pratique, il combine la qualité de la récupération (retrieval), la rigueur des prompts et la gouvernance pour que les réponses restent précises, explicables et maintenables à mesure que les connaissances évoluent.

Le terme RAG provient de l'article original sur la Retrieval-Augmented Generation (Lewis et al., NeurIPS 2020), qui combine les connaissances paramétriques d'un modèle avec une mémoire non paramétrique. L'avantage principal est opérationnel : vous pouvez mettre à jour votre base de connaissances sans réentraîner le modèle à chaque modification de contenu.

Chez Optijara, nous traitons le RAG comme un problème de conception de système, et non comme une simple astuce de prompt. Une bonne implémentation nécessite des pipelines de documents clairs, des embeddings performants, un chunking robuste, une évaluation de la récupération, des contraintes de style de réponse et des contrôles de sécurité qui réduisent les modes de défaillance évitables.

Pourquoi les équipes devraient-elles utiliser le RAG plutôt que des réponses basées uniquement sur le modèle ?

Les équipes devraient utiliser le RAG lorsque la précision, la fraîcheur des données et la traçabilité des sources sont primordiales, car les réponses basées uniquement sur le modèle peuvent être fluides mais obsolètes ou invérifiables. Le RAG améliore la fiabilité pratique en ancrant les sorties dans des documents contrôlés et en permettant les citations, l'auditabilité et des mises à jour rapides, ce qui est essentiel dans les flux de travail juridiques, d'entreprise, de santé et de support technique.

L'article RAG de 2020 rapporte que les configurations augmentées par récupération ont atteint des résultats de pointe (state-of-the-art) sur trois tâches de QA à domaine ouvert et ont produit des sorties plus factuelles qu'une base de référence solide uniquement paramétrique. Cela n'élimine pas les erreurs, mais valide la direction architecturale pour les tâches intensives en connaissances.

Le comportement des développeurs soutient également ce changement. Dans l'enquête 2024 de Stack Overflow, 62 % des répondants ont déclaré utiliser actuellement des outils d'AI et 76 % les utilisaient ou prévoyaient de les utiliser dans leurs flux de travail de développement. À mesure que l'usage de l'AI croît, l'ancrage et la vérification deviennent des exigences opérationnelles et non des options facultatives.

Comment concevoir une architecture RAG fiable étape par étape ?

Concevez un RAG fiable en séparant les responsabilités en cinq couches : ingestion, indexation, récupération (retrieval), génération et évaluation. Chaque couche doit avoir des contrats explicites, des métriques et des chemins de retour en arrière (rollback). Cette approche modulaire empêche le couplage masqué, facilite le débogage des incidents et permet aux équipes d'améliorer les composants indépendamment sans déstabiliser l'ensemble de l'assistant.

- Ingestion : Collectez des documents sources de confiance, normalisez les formats, supprimez les doublons et suivez les métadonnées de version.

- Indexation : Découpez les documents (chunking), générez des embeddings et stockez les vecteurs avec les identifiants sources et les horodatages.

- Récupération (Retrieval) : Utilisez une récupération hybride (sémantique + mots-clés) et un reranking optionnel pour plus de précision.

- Génération : Contraignez les prompts pour qu'ils répondent uniquement à partir du contexte récupéré et citent les sources.

- Évaluation : Mesurez séparément la qualité de la récupération et la qualité des réponses avant la mise en service.

Cette architecture s'aligne sur les recommandations du cadre de gestion des risques AI du NIST : la fiabilité doit être intégrée dès la conception dans les flux de développement, de déploiement et d'évaluation, et non corrigée après le lancement.

Comment préparer les documents et les segments (chunks) pour une qualité de récupération optimale ?

Préparez les documents en préservant les frontières sémantiques, en gardant des segments compacts et en y attachant des métadonnées riches. Un bon chunking améliore le rappel (recall) sans inonder la fenêtre de contexte du modèle. Un défaut pratique est le chunking basé sur les titres avec chevauchement, puis un ajustement itératif basé sur les requêtes échouées, plutôt que des nombres de tokens statiques et universels.

Utilisez ces règles documentaires :

- Découpez d'abord par en-têtes de section, puis par taille de paragraphe.

- Maintenez une longueur de segment cohérente (par exemple, 300 à 700 tokens) avec 10 à 20 % de chevauchement.

- Stockez les métadonnées : titre, URL, langue, domaine produit, version et date de mise à jour.

- Évitez d'entasser des sujets non liés dans un seul segment ; cela nuit à la précision de la récupération.

- Filtrez le contenu générique (navigation, texte de cookies, pieds de page juridiques) avant l'embedding.

Le MTEB (Massive Text Embedding Benchmark) est largement utilisé pour comparer la qualité des embeddings à travers la récupération et les tâches connexes. Utilisez les résultats du benchmark comme point de départ, mais validez toujours sur vos propres requêtes de domaine avant de sélectionner un modèle d'embedding.

Quelle stratégie de récupération fonctionne le mieux pour les assistants d'entreprise ?

Pour la plupart des cas d'usage en entreprise, la récupération hybride avec reranking offre le meilleur compromis en production : la recherche sémantique améliore le rappel, la recherche par mots-clés/BM25 améliore la précision des correspondances exactes, et le reranking améliore la pertinence finale. Cette combinaison réduit les échecs liés aux requêtes riches en acronymes, aux identifiants de politiques et à la terminologie spécifique aux versions, courante dans les bases de connaissances internes.

Un pipeline de récupération pratique ressemble à ceci :

# 1) Récupération sémantique (top_k=20)

# 2) Récupération par mots-clés (top_k=20)

# 3) Fusion + dédoublonnage

# 4) Reranking pour garder top_k=6

# 5) Passage des meilleurs contextes au générateur avec modèle de citation

Commencez par une récupération orientée vers le rappel, puis affinez avec le reranking. Les équipes qui sur-optimisent la latence trop tôt nuisent souvent à la pertinence. Améliorez la vitesse après avoir établi des seuils de qualité minimaux sur votre jeu d'évaluation.

Comment rédiger des prompts qui réduisent les hallucinations dans le RAG ?

Rédigez des prompts qui imposent explicitement des limites de preuves : répondez à partir du contexte fourni, citez les sources et exprimez l'incertitude lorsque les preuves manquent. Le modèle anti-hallucination le plus efficace n'est pas seulement un langage de type "soyez précis" ; ce sont des exigences de sortie structurées combinées à un comportement de refus lorsque la confiance de récupération est faible.

Utilisez un modèle de système tel que :

Vous êtes un assistant d'entreprise.

Règles :

1) Utilisez uniquement le contexte récupéré.

2) Si le contexte est insuffisant, dites : "Je n'ai pas assez de preuves dans les sources fournies."

3) Fournissez les citations sous la forme [Source : titre, section].

4) Séparez les faits des recommandations.

Ensuite, validez les sorties avec des vérifications automatisées :

- Détecteur de citations manquantes

- Vérification du chevauchement entre affirmation et source

- Liste noire/blanche de phrases de politique

- Garde-fous sur la longueur de réponse pour les flux critiques

Comment évaluer la qualité du RAG avant la mise en service ?

Évaluez le RAG avec deux fiches d'évaluation : la qualité de la récupération et la qualité de la réponse. Les métriques de récupération indiquent si les bonnes preuves ont été trouvées ; les métriques de réponse indiquent si le modèle a utilisé ces preuves correctement. Séparer ces couches évite les erreurs de diagnostic et aide les équipes à corriger le bon composant plus rapidement.

| Couche | Métrique | Pourquoi c'est important |

|---|---|---|

| Récupération | Recall@k | Vérifie si les documents pertinents apparaissent dans les top-k résultats. |

| Récupération | nDCG@k | Récompense la qualité du classement, pas seulement la présence. |

| Génération | Fidélité (Faithfulness) | Mesure si les affirmations sont étayées par le contexte récupéré. |

| Génération | Précision des citations | Confirme que les références pointent vers les bons segments sources. |

| UX | Taux de succès de la tâche | Capture si les utilisateurs résolvent réellement leur problème. |

Construisez un jeu de test de référence (gold set) à partir de questions d'utilisateurs réels, incluant des prompts contradictoires et des requêtes ambiguës. Relancez les évaluations après tout changement de modèle, d'embedding ou de chunking, et bloquez le déploiement si la fidélité tombe en dessous de votre seuil convenu.

Quels contrôles de sécurité sont obligatoires pour un assistant RAG en production ?

Les contrôles obligatoires incluent les défenses contre l'injection de prompt, la validation des sorties, l'accès aux outils selon le principe du moindre privilège et la protection des données sensibles. Le Top 10 de l'OWASP pour les applications LLM souligne des risques récurrents tels que l'injection de prompt, la manipulation non sécurisée des sorties et l'agentivité excessive. Traitez-les comme des exigences d'ingénierie de base, surtout lorsque les assistants peuvent déclencher des actions.

- Atténuation de l'injection de prompt : Séparez le contenu utilisateur des instructions système et des schémas d'outils.

- Gestion non sécurisée des sorties : Assainissez les sorties du modèle avant le rendu ou l'exécution.

- Contrôles des données sensibles : Masquez les PII/secrets lors des étapes d'ingestion et de réponse.

- Gouvernance des accès : Appliquez des filtres de récupération basés sur les rôles par identité utilisateur.

- Sauvegardes d'action : Ajoutez une confirmation humaine pour les opérations destructrices.

L'AI RMF du NIST et le profil Generative AI offrent une perspective de gouvernance pratique : cartographier les modes de défaillance, définir les contrôles, mesurer le risque résiduel et itérer. La sécurité n'est pas un audit ponctuel ; c'est une opération continue.

Combien coûte l'exploitation d'un assistant RAG et comment contrôler les dépenses ?

Le coût du RAG est dicté par l'utilisation des tokens, l'infrastructure de récupération et les objectifs de latence. Vous pouvez contrôler les dépenses en réduisant le contexte inutile, en utilisant la mise en cache et en adaptant la taille du modèle à la complexité de la tâche. Commencez par des bases de référence de qualité, puis optimisez le coût par tâche réussie plutôt que le coût par requête isolée.

Les composants de coût incluent généralement :

- Génération d'embeddings pour l'indexation et les mises à jour de documents

- Stockage et requêtes dans la base de données vectorielle

- Inférence du modèle de reranking (si activé)

- Tokens d'entrée/sortie du modèle de génération

Les références de prix d'exemple doivent toujours être vérifiées par rapport aux pages officielles des fournisseurs avant publication. Par exemple, la page de tarification d'OpenAI documente les tarifs basés sur les tokens et les structures de prix des appels d'outils, et ces valeurs peuvent changer. Utilisez des vérifications programmées et évitez de coder en dur des hypothèses dans le contenu public.

À quoi ressemble une implémentation minimale en code ?

Une implémentation minimale ne nécessite que quatre primitives : transformer les documents en embeddings, récupérer les candidats, construire un prompt contraint et générer avec des citations. Gardez la première version intentionnellement simple, puis ajoutez le reranking, la mise en cache et les vérifications de politique une fois que vous pouvez mesurer les erreurs de base avec des requêtes d'utilisateurs réels.

# Pseudocode pour une boucle RAG minimale

query = user_input()

q_vec = embed(query)

semantic_hits = vector_db.search(q_vec, top_k=10)

keyword_hits = bm25.search(query, top_k=10)

contexts = rerank_and_select(semantic_hits + keyword_hits, top_k=6)

prompt = compose_prompt(

query=query,

contexts=contexts,

rules=[

"Utilisez uniquement le contexte fourni",

"Citez chaque affirmation factuelle",

"Si les preuves manquent, dites-le"

]

)

answer = llm.generate(prompt)

return post_validate(answer)

En production, enveloppez cela avec de l'observabilité (latence, taux de réussite de récupération, couverture des citations), des logs structurés pour l'examen des incidents et des alertes lorsque la fidélité ou le succès des tâches se dégrade.

Comment les équipes devraient-elles déployer le RAG en toute sécurité en 30 jours ?

Déployez le RAG en 30 jours en séquençant le périmètre : semaine une pour les données et les questions de test, semaine deux pour la qualité de récupération, semaine trois pour les contrôles de réponse et les barrières de sécurité, et semaine quatre pour la surveillance pilote. Cette approche progressive réduit le risque de lancement et donne aux parties prenantes des points de contrôle mesurables avant le déploiement complet.

- Semaine 1 : Définir les tâches cibles, organiser les documents de confiance, construire le jeu d'évaluation.

- Semaine 2 : Implémenter le chunking/indexation, ajuster la récupération, benchmarker le Recall@k et le nDCG.

- Semaine 3 : Ajouter des prompts contraints, des vérifications de citations et des sauvegardes alignées sur l'OWASP.

- Semaine 4 : Lancer un pilote avec des utilisateurs sélectionnés, analyser les échecs, finaliser les critères de go/no-go.

C'est ici que l'avantage structurel d'Optijara compte : des conseils d'architecture cohérents, des modèles de gouvernance et des pratiques d'optimisation itératives facilitent la mise à l'échelle des assistants AI à travers les équipes et les régions.

FAQ : Quelle est la différence entre le fine-tuning et le RAG ?

Le fine-tuning met à jour le comportement du modèle par un entraînement supplémentaire, tandis que le RAG maintient le modèle fixe et injecte des preuves externes au moment de la requête. Utilisez le fine-tuning pour le style, le format ou le comportement politique ; utilisez le RAG pour les connaissances évolutives. De nombreux systèmes de production combinent les deux, mais le RAG est généralement le chemin le plus rapide vers la fraîcheur factuelle.

Le RAG est opérationnellement moins coûteux à mettre à jour lorsque les documents changent quotidiennement. Le fine-tuning peut toujours aider pour une structure de sortie cohérente ou un ton de domaine, mais il ne devrait pas être votre mécanisme principal pour des faits changeant fréquemment.

FAQ : Le RAG peut-il éliminer complètement les hallucinations ?

Non, le RAG ne peut pas éliminer complètement les hallucinations, mais il peut les réduire considérablement lorsque la qualité de la récupération, le prompting et la validation sont bien conçus. Des échecs surviennent toujours via une récupération non pertinente, un classement faible ou des inférences de modèle non étayées. Traitez le RAG comme une architecture de réduction des risques, pas comme une garantie, et maintenez des parcours d'escalade humaine pour les décisions à enjeux élevés.

Votre objectif est une réduction mesurable des affirmations non étayées, avec une surveillance claire et une réponse aux incidents lorsque la qualité baisse.

FAQ : Quelle est une bonne taille de segment (chunk size) de départ pour les documents d'entreprise ?

Une plage de départ pratique est de 300 à 700 tokens avec un chevauchement modéré, puis ajustez selon les performances des requêtes. Des segments plus petits peuvent améliorer la précision mais nuire à la complétude du contexte, tandis que des segments plus grands peuvent diluer la pertinence. Évaluez la taille des segments par rapport à votre propre jeu de données et vos questions plutôt que de copier des valeurs par défaut génériques issues de tutoriels.

Le chunking basé sur les titres surpasse souvent le découpage à taille fixe car il préserve les frontières de sens que les modèles de récupération et les rerankers peuvent exploiter.

FAQ : Quelles métriques la direction devrait-elle suivre chaque semaine ?

La direction devrait suivre le taux de succès des tâches, la précision des citations, le taux de requêtes non résolues, le percentile de latence et le coût par tâche réussie. Ces métriques alignent les résultats commerciaux avec la qualité technique et l'efficacité opérationnelle. Surveiller uniquement la dépense en tokens ou uniquement la précision du modèle crée des angles morts qui peuvent masquer des problèmes de fiabilité ou de confiance.

Maintenez un tableau de bord pour les cadres et un autre pour la profondeur technique. Des définitions partagées empêchent les interprétations contradictoires entre les équipes.

Sources

- Lewis et al. (2020), Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks

- NIST AI Risk Management Framework (AI RMF)

- OWASP Top 10 for LLM Applications / GenAI Security Project

- MTEB: Massive Text Embedding Benchmark (GitHub)

- Stack Overflow Developer Survey 2024 — AI section

- OpenAI API Pricing

Rédigé par

Optijara AI