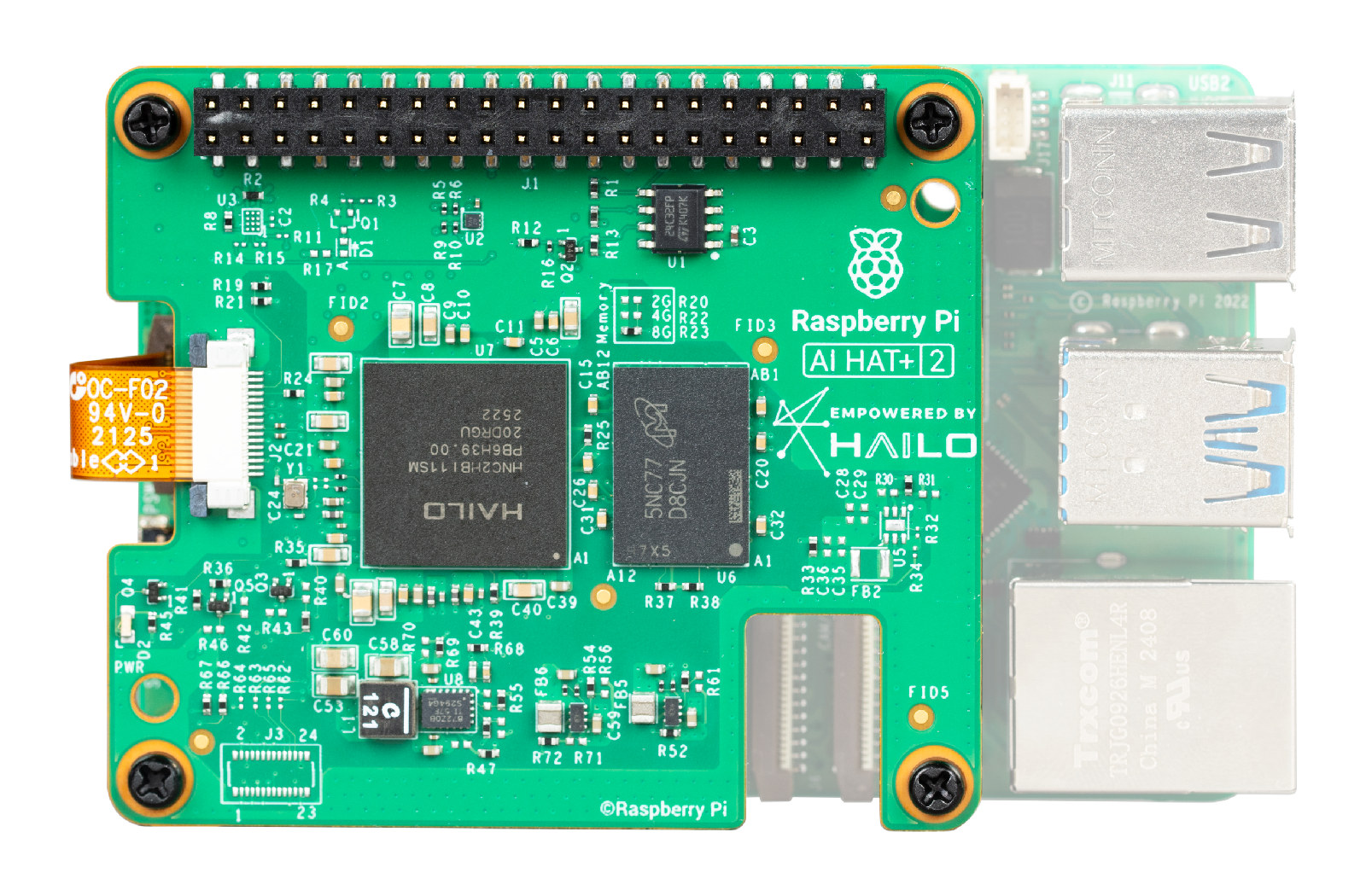

Raspberry Pi AI HAT+ 2 : Exécutez des LLM Localement pour Seulement 130 $

Le Raspberry Pi AI HAT+ 2 apporte des LLM locaux à la périphérie avec la puce Hailo 10H, 8 Go de RAM dédiée et la prise en charge de DeepSeek, Llama et Qwen, le tout fonctionnant hors ligne avec seulement 3 watts.

L'essor de l'IA souveraine en périphérie

Pendant des années, la promesse de l'IA générative a été liée au cloud. Cette dépendance s'accompagne souvent d'obstacles importants : latence élevée, coûts d'abonnement récurrents et préoccupations complexes concernant la confidentialité des données. Cependant, le paysage de l'informatique en périphérie vient de subir un changement radical. La sortie du Raspberry Pi AI HAT+ 2 marque un tournant, offrant une solution haute performance et basse consommation pour l'exécution locale de grands modèles de langage (LLM) pour un investissement matériel unique de seulement 130 $.

La possibilité de déployer des modèles tels que DeepSeek, Llama et Qwen sur un appareil qui tient dans la paume de votre main - et consomme seulement 3 watts de puissance - ouvre des portes sans précédent pour l'IoT industriel, les interfaces vocales sécurisées et l'automatisation d'entreprise localisée dans tous les secteurs d'activité.

Percée technique : le Hailo 10H et 8 Go de RAM dédiée

Le cœur du Raspberry Pi AI HAT+ 2 est le module d'accélération IA Hailo 10H. Alors que les précédents accélérateurs d'IA pour le Pi se concentraient principalement sur la vision par ordinateur et la détection d'objets, l'AI HAT+ 2 est explicitement conçu pour l'ère générative. Il offre jusqu'à 40 TOPS (Tera Operations Per Second) de performances, mais la véritable innovation du matériel réside dans son architecture de mémoire.

Mémoire dédiée pour les grands modèles

Contrairement aux modules complémentaires NPU standard qui partagent la RAM du système hôte, l'AI HAT+ 2 dispose de 8 Go de RAM LPDDR4x dédiée. Ceci est essentiel pour le déploiement de LLM. Le goulot d'étranglement est rarement uniquement le calcul - c'est la bande passante et la capacité de la mémoire. En fournissant 8 Go d'espace dédié, le HAT permet au Raspberry Pi 5 de charger entièrement les poids du modèle sur l'accélérateur, libérant ainsi les ressources du Pi pour la logique d'application.

- Chipset : Processeur IA Hailo 10H

- Performance : 40 TOPS (INT4)

- Mémoire : 8 Go de RAM LPDDR4x dédiée

- Consommation : ~3 Watts sous des charges de travail typiques

- Interface : PCIe 3.0 via le connecteur FPC Raspberry Pi 5

- Prix : 130 $

Modèles pris en charge : DeepSeek, Llama et Qwen

La caractéristique la plus intéressante est la prise en charge vérifiée des architectures LLM modernes. Grâce au Hailo Model Zoo et aux piles logicielles optimisées, l'AI HAT+ 2 exécute des versions quantifiées des principaux modèles open source :

DeepSeek-R1-Distill (1,5B)

DeepSeek a gagné énormément de popularité pour son efficacité de raisonnement. Le modèle R1 distillé fonctionne sans problème sur l'AI HAT+ 2, parfait pour l'assistance au codage, le raisonnement en chaîne de pensée et les tâches spécialisées au sein d'un réseau fermé.

Llama 3.2 de Meta (1B)

Llama 3.2 est la norme de l'industrie pour l'IA locale à usage général. Avec 40 TOPS de puissance, l'AI HAT+ 2 atteint des taux de jetons par seconde utilisables pour les applications de chat en temps réel, ce qui est viable pour les bornes de service client ou les bases de connaissances internes.

Famille Qwen 2.5 d'Alibaba (1,5B)

Qwen 2.5 comprend des variantes Instruct et Coder, offrant de solides capacités multilingues et de génération de code. L'exécution de Qwen localement garantit des réponses à latence nulle sans frais d'API.

Pourquoi exécuter des LLM localement ?

1. Confidentialité et sécurité des données

Lorsque l'IA fonctionne localement, les données ne quittent jamais l'appareil. Il n'y a aucun risque que des données sensibles soient utilisées pour entraîner des modèles cloud tiers. Cette approche d'« IA à circuit fermé » est essentielle pour les applications de soins de santé, financières, juridiques et gouvernementales.

2. Latence nulle

Les appels d'API cloud introduisent une latence réseau. L'inférence locale fournit des réponses instantanées, ce qui est essentiel pour les interfaces vocales, l'automatisation en temps réel et les applications interactives.

3. Pas de coûts récurrents

Les API d'IA cloud facturent par jeton. Pour les cas d'utilisation à volume élevé, les coûts s'additionnent rapidement. L'AI HAT+ 2 est un investissement unique de 130 $ avec une inférence locale illimitée.

4. Fonctionnement hors ligne

Les appareils en périphérie fonctionnent souvent dans des environnements où Internet n'est pas fiable ou indisponible. Un appareil de 3 watts alimenté par énergie solaire ou par batterie peut fournir des diagnostics intelligents et des interfaces vocales n'importe où.

Cas d'utilisation pratiques

- Assistants vocaux locaux : Traitez la synthèse vocale et les réponses LLM sans dépendance au cloud

- IoT industriel : Maintenance prédictive et diagnostics en périphérie

- Vente au détail intelligente : Bornes alimentées par l'IA qui fonctionnent hors ligne

- Bureaux intelligents axés sur la confidentialité : Assistants de salle de réunion qui ne transmettent pas de données à l'extérieur

- Robotique : Intelligence embarquée pour les systèmes autonomes

- Éducation : Laboratoires d'IA abordables pour les écoles et les universités

Considérations de mise en œuvre

L'exécution de LLM sur du matériel en périphérie nécessite une quantification, c'est-à-dire la compression des poids du modèle de 16 bits à 4 bits ou 8 bits pour qu'ils tiennent dans l'enveloppe mémoire de 8 Go. Cela réduit légèrement la capacité du modèle, mais le compromis en termes de vitesse, de confidentialité et de coût est généralement préféré pour des tâches spécifiques.

Le refroidissement est également important. Malgré la faible consommation de 3 W, le Raspberry Pi 5 et l'AI HAT+ 2 doivent être logés dans un boîtier à refroidissement actif pour des sessions d'inférence soutenues.

Pour commencer

L'AI HAT+ 2 est disponible dès maintenant auprès des revendeurs officiels Raspberry Pi. Vous aurez besoin de :

- Raspberry Pi 5 (8 Go recommandé)

- Raspberry Pi OS à jour

- Solution de refroidissement actif

Consultez la documentation officielle et le GitHub de Hailo pour télécharger les modèles et les guides d'installation.

Conclusion : L'avenir est local

Le Raspberry Pi AI HAT+ 2 n'est pas seulement un outil pour les amateurs, c'est un accélérateur de qualité professionnelle qui démocratise l'IA locale. Pour 130 $, vous obtenez un appareil qui exécute les modèles DeepSeek, Llama et Qwen complètement hors ligne, sans frais d'API, sans latence et avec une confidentialité totale des données.

L'ère de l'IA souveraine en périphérie est arrivée. La question n'est pas de savoir s'il faut déployer l'IA localement, mais à quelle vitesse vous pouvez commencer.

Rédigé par

Optijara AI