Le déploiement de l'infrastructure IA à mille milliards de dollars : ce que les développeurs doivent savoir

NVIDIA a doublé ses prévisions de demande de puces IA à mille milliards de dollars lors de la GTC 2026. Les hyperscalers prévoient 720 milliards de capex combinés cette année. Voici ce que ce déploiement signifie pour les développeurs et les fondateurs.

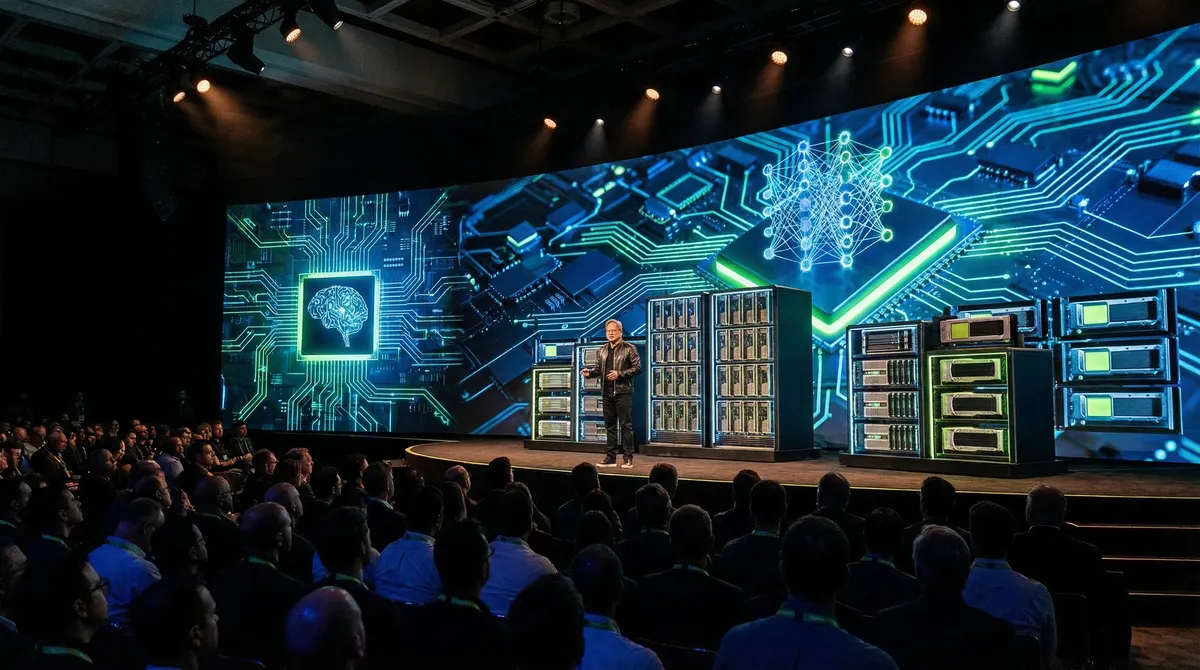

Lors de la GTC 2026, le 17 mars, le PDG de NVIDIA, Jensen Huang, a doublé les prévisions de demande de son entreprise : « Au moins 1 000 milliards de dollars d'ici 2027 », a-t-il déclaré. « En fait, nous allons être à court. Je suis certain que la demande en puissance de calcul sera bien plus élevée que cela. » La précédente estimation, faite lors de l'appel sur les résultats de NVIDIA en février, était de 500 milliards de dollars. En un mois, l'opportunité projetée a doublé.

Ce n'est pas un signal isolé. Les quatre plus grands hyperscalers — Alphabet, Meta, Microsoft et Amazon — ont collectivement orienté leurs prévisions vers 700 milliards de dollars de dépenses d'investissement (capex) pour 2026. Meta a signé à lui seul un accord d'infrastructure de 27 milliards de dollars avec Nebius et prévoit jusqu'à 135 milliards de dollars de capex liés à l'IA cette année. Amazon a annoncé 200 milliards de dollars, soit 50 milliards de plus que les prévisions des analystes.

Pour les développeurs, les fondateurs et les leaders techniques, ces chiffres se traduisent par des changements concrets : disponibilité du compute, coûts, méthodes de construction des applications et décisions d'infrastructure cruciales pour les 12 à 18 prochains mois.

Quelle est l'ampleur du déploiement de l'infrastructure IA ?

Le capex IA combiné des hyperscalers pour 2026 approche les 720 milliards de dollars dans le haut des fourchettes de prévision. Pour mettre cela en contexte, ce chiffre rivalise avec le PIB de la Suède et dépasse de plus du double le coût (ajusté à l'inflation) de l'ensemble du programme Apollo. Le chiffre d'affaires de NVIDIA pour l'exercice 2026 a atteint 215,9 milliards de dollars, en hausse de 65 % sur un an, avec des revenus pour les centres de données s'élevant à eux seuls à 62,3 milliards de dollars pour le quatrième trimestre.

Les dépenses informatiques mondiales devraient dépasser les 6 000 milliards de dollars pour la première fois en 2026, selon Gartner. Les charges de travail liées à l'IA sont le principal moteur de croissance, 42 % des organisations citant l'optimisation des flux de travail IA comme leur priorité absolue en matière de dépenses.

Où va l'argent

Les dépenses se répartissent en plusieurs catégories qui affectent directement l'écosystème des développeurs :

Approvisionnement en GPU et accélérateurs. Les puces IA Blackwell et Rubin de NVIDIA restent les cibles prioritaires. La prévision de 1 000 milliards de dollars reflète la demande pour l'inférence (exécution de modèles entraînés en production) autant que pour l'entraînement. Jensen Huang a spécifiquement souligné que le passage vers les charges de travail d'inférence représentait l'opportunité de revenus la plus importante.

Construction de centres de données. De nouvelles installations sont construites à une échelle sans précédent. L'accord de 27 milliards de dollars de Meta avec Nebius couvre le déploiement d'infrastructures IA dans plusieurs régions. Microsoft, Amazon et Google construisent chacun des installations à l'échelle de campus conçues spécifiquement pour les charges de travail IA, avec des systèmes de refroidissement personnalisés et des architectures de distribution d'énergie dédiées.

Infrastructure énergétique. Les centres de données IA consomment nettement plus d'électricité que les installations cloud traditionnelles. Cela a créé un déploiement d'infrastructure parallèle dans l'énergie : nouvelle production d'électricité, mises à niveau du réseau et installations de production sur site. La demande énergétique est telle que NVIDIA a annoncé des concepts d'informatique spatiale lors de la GTC 2026, et Elon Musk a évoqué l'informatique orbitale comme une solution potentielle aux contraintes énergétiques terrestres.

Réseautage et interconnexion. Les connexions à haut débit entre les clusters de GPU et entre les centres de données constituent un centre de coûts croissant. Les technologies NVLink et InfiniBand de NVIDIA gèrent la communication intra-cluster, tandis que les hyperscalers investissent dans des réseaux de fibre dédiés entre les régions.

L'économie de l'inférence : un changement structurel

La prévision de 1 000 milliards de dollars de NVIDIA cible spécifiquement l'opportunité de l'inférence. L'entraînement d'un grand modèle est un coût ponctuel (ou périodique). L'exécution de ce modèle à grande échelle — l'inférence — est continue et évolue avec la demande des utilisateurs.

Ce changement est crucial pour les développeurs et les fondateurs pour plusieurs raisons :

| Aspect | Ère de l'entraînement | Ère de l'inférence |

|---|---|---|

| Structure des coûts | Initiale, par lots (batch) | Continue, par requête |

| Priorité matérielle | Puissance brute | Latence + débit |

| Enjeu de mise à l'échelle | Taille du modèle | Utilisateurs simultanés |

| Impact développeur | Peu d'équipes entraînent | Chaque app exécute l'inférence |

| Modèle économique | Axé sur la recherche | Axé sur l'usage |

L'économie de l'inférence signifie que le coût et la disponibilité de l'exécution des modèles d'IA en production déterminent directement quelles applications sont économiquement viables. À mesure que l'infrastructure se développe, les coûts d'inférence chutent, permettant de nouvelles catégories d'applications auparavant trop coûteuses à exploiter.

Ce que cela signifie pour les développeurs

Le compute devient plus accessible, pas moins. Malgré les chiffres de capex vertigineux, le déploiement augmente l'offre plus rapidement que la demande pour de nombreux niveaux de charge de travail. Les API d'inférence serverless des fournisseurs cloud, les points de terminaison d'inférence spécialisés des vendeurs de modèles et les options de déploiement edge sont en pleine expansion. Les développeurs créant des applications sur des modèles de fondation verront les rapports prix-performance s'améliorer tout au long de 2026 et 2027.

Les stratégies multi-cloud et multi-fournisseurs sont désormais essentielles. Aucun hyperscaler ne peut absorber seul l'intégralité de la demande. Les développeurs doivent architecturer leurs applications pour qu'elles fonctionnent chez plusieurs fournisseurs, en utilisant des couches d'abstraction permettant de basculer entre les points de terminaison d'inférence. C'est particulièrement important pour les startups qui ne souhaitent pas s'engager sur la trajectoire tarifaire d'un seul fournisseur.

L'inférence à la périphérie (edge) s'accélère. Toutes les charges de travail n'ont pas besoin de GPU en centre de données. Apple Silicon, les accélérateurs IA de Qualcomm et la plateforme Jetson de NVIDIA permettent une inférence significative au niveau local. Pour les applications sensibles à la latence (traduction en temps réel, systèmes autonomes, assistants sur l'appareil), le déploiement de l'infrastructure inclut le compute local, pas seulement le cloud.

Le ratio modèle/infrastructure évolue. À mesure que l'infrastructure se développe, le goulot d'étranglement passe de « pouvons-nous exécuter ce modèle ? » à « pouvons-nous l'exécuter efficacement ? ». Des techniques comme la quantification, la distillation, le décodage spéculatif et les architectures Mixture-of-Experts deviennent des compétences de base pour les développeurs plutôt que de simples sujets de recherche.

Ce que cela signifie pour les fondateurs

Les coûts d'infrastructure IA sont désormais un poste de dépense principal. Pour toute startup se construisant sur l'IA, les coûts de calcul sont probablement la première ou deuxième catégorie de dépenses. Comprendre comment optimiser les coûts d'inférence — sélection du modèle, stratégies de batching, couches de mise en cache et négociation avec les fournisseurs — est une compétence clé, pas un simple exercice d'optimisation.

La fenêtre pour les startups « AI-native » est ouverte mais se réduit. Le déploiement des hyperscalers crée une capacité massive qui finira par banaliser de nombreuses capacités d'IA. Les startups qui construisent une différenciation défendable via des données propriétaires, du fine-tuning spécifique à un domaine ou des architectures d'application novatrices ont une opportunité maintenant, pendant que l'infrastructure est encore en cours de déploiement. Rivaliser sur la capacité brute des modèles contre des entreprises dépensant plus de 100 milliards de dollars par an n'est pas une stratégie viable.

La répartition géographique compte. Le déploiement de l'infrastructure n'est pas uniforme. Les États-Unis, certaines parties de l'Europe et certains marchés asiatiques reçoivent l'essentiel de la nouvelle capacité. Les fondateurs ciblant les marchés émergents doivent tenir compte d'une latence plus élevée et de coûts potentiellement plus importants pour les charges de travail IA dans ces régions.

L'économie des tokens : un aperçu de la transformation des rémunérations

Lors de la GTC 2026, Jensen Huang a introduit un concept qui montre à quel point l'infrastructure IA pénètre les opérations organisationnelles : payer les ingénieurs en tokens IA en complément du salaire de base.

« Chaque ingénieur de notre entreprise aura besoin d'un budget annuel de tokens », a-t-il déclaré. « Ils gagneront quelques centaines de milliers de dollars par an en salaire de base. Je vais probablement leur donner la moitié de cette somme en plus sous forme de tokens afin que leur capacité soit décuplée. »

Aux niveaux décrits, les ingénieurs auraient accès à des milliards de tokens par an. Huang a présenté cela comme un outil de recrutement compétitif : « C'est désormais l'un des outils de recrutement de la Silicon Valley : combien de tokens accompagnent mon poste. »

Que la rémunération en tokens se généralise ou non, la logique sous-jacente est significative. Les entreprises commencent à traiter le compute IA comme un multiplicateur de productivité ayant une valeur quantifiable par employé. Cela a des implications sur la manière dont les organisations budgétisent, mesurent la productivité des développeurs et structurent les packages de rémunération sur les marchés concurrentiels.

Risques et questions en suspens

Est-ce une bulle ? Le PDG de Microsoft, Satya Nadella, et l'investisseur Michael Burry ont tous deux exprimé des inquiétudes concernant l'excès d'investissement dans l'IA. Le contre-argument : la croissance des revenus de NVIDIA (65 % sur un an à 215,9 milliards de dollars) démontre que la demande est réelle et actuelle, pas spéculative. Le risque n'est pas que la demande n'existe pas, mais que le déploiement de l'offre puisse dépasser les besoins dans certains segments de marché spécifiques.

Durabilité énergétique. La consommation électrique des centres de données IA est une véritable contrainte. L'industrie investit dans le nucléaire, le solaire et les mises à niveau du réseau, mais le calendrier de production d'énergie ne correspond pas toujours à celui du déploiement des centres de données.

Risque de concentration. NVIDIA contrôle la majorité du marché des accélérateurs IA. AMD a du mal à combler l'écart malgré les discussions sur un accord de puces de 100 milliards de dollars avec Meta. Cette concentration crée un risque pour la chaîne d'approvisionnement de tout l'écosystème et maintient le pouvoir de fixation des prix fermement entre les mains de NVIDIA.

Points clés à retenir

- NVIDIA a doublé ses prévisions de demande de puces IA à 1 000 milliards de dollars d'ici 2027, contre 500 milliards seulement un mois plus tôt.

- Les quatre plus grands hyperscalers prévoient environ 700 à 720 milliards de dollars de capex IA combinés pour 2026.

- Les dépenses passent de l'entraînement à l'inférence, ce qui affecte directement l'économie des applications.

- Les développeurs doivent concevoir des architectures flexibles multi-fournisseurs et investir dans des compétences d'optimisation de l'inférence.

- Les fondateurs doivent traiter les coûts de calcul IA comme une compétence de base, et non comme une réflexion après coup.

- La rémunération basée sur les tokens émerge comme un différenciateur de recrutement dans la Silicon Valley.

FAQ

Pourquoi NVIDIA a-t-elle doublé ses prévisions de demande si rapidement ?

L'augmentation de 500 milliards à 1 000 milliards reflète le basculement vers les charges de travail d'inférence. L'entraînement crée une demande ponctuelle, mais l'inférence évolue avec chaque utilisateur d'application. À mesure que davantage d'applications de production adoptent des fonctionnalités d'IA, la demande d'inférence croît plus vite que ne le projetaient les modèles précédents.

Comment les dépenses des hyperscalers affectent-elles les fondateurs de startups ?

Cela augmente la capacité de calcul disponible, ce qui réduit généralement les coûts d'inférence au fil du temps. Cependant, cela signifie également que les hyperscalers proposeront davantage de capacités d'IA intégrées à leurs plateformes, banalisant potentiellement des fonctionnalités que les startups facturent actuellement. Les fondateurs doivent construire des barrières défendables via des données propriétaires ou des architectures d'application uniques.

L'investissement dans l'infrastructure IA est-il une bulle ?

Les preuves actuelles suggèrent que la demande est réelle : NVIDIA a affiché 215,9 milliards de dollars de revenus avec une croissance de 65 %, et les hyperscalers signalent un fort retour sur investissement pour l'IA. Le risque réside dans une potentielle sur-offre dans certains segments ou un ralentissement de l'adoption de l'IA en entreprise qui ne correspondrait pas au rythme de déploiement de l'infrastructure.

Que doivent apprendre les développeurs pour se préparer ?

Concentrez-vous sur l'optimisation de l'inférence : quantification, distillation de modèles, décodage spéculatif et batching efficace. La compréhension du déploiement multi-cloud et de l'optimisation des coûts entre les fournisseurs sera de plus en plus précieuse à mesure que le paysage de l'infrastructure s'étend.

Les coûts d'inférence continueront-ils de baisser ?

Oui, sur la base des tendances historiques et de l'ampleur des investissements actuels. Une offre accrue, un meilleur matériel (comme l'architecture Rubin de NVIDIA) et des optimisations logicielles (mixture-of-experts, mécanismes d'attention efficaces) devraient continuer à faire baisser les coûts tout au long de 2026-2027.

Sources

- https://www.reuters.com/world/asia-pacific/nvidia-ceo-set-reveal-new-chips-software-ai-megaconference-gtc-2026-03-16/

- https://fortune.com/2026/03/17/jensen-huang-ai-infrastructure-buildout-1-trillion-dollars/

- https://www.cnbc.com/2026/03/16/meta-nebius-ai-infrastructure.html

- https://blogs.nvidia.com/blog/state-of-ai-report-2026/

- https://finance.yahoo.com/news/hyperscalers-spending-nearly-700-billion-115600158.html

- https://www.fool.com/investing/2026/03/17/big-tech-is-spending-720-billion-on-ai-in-2026-and/

- https://www.fool.com/investing/2026/03/14/it-spending-will-exceed-6-trillion-for-the-first-t/

Rédigé par

Optijara