Como Construir um Assistente RAG Pronto para Produção em 2026: Um Tutorial Passo a Passo

O que é um assistente RAG pronto para produção em 2026? Um assistente RAG pronto para produção é um sistema de AI que recupera documentos relevantes e atualizados no momento da

O que é um assistente RAG pronto para produção em 2026?

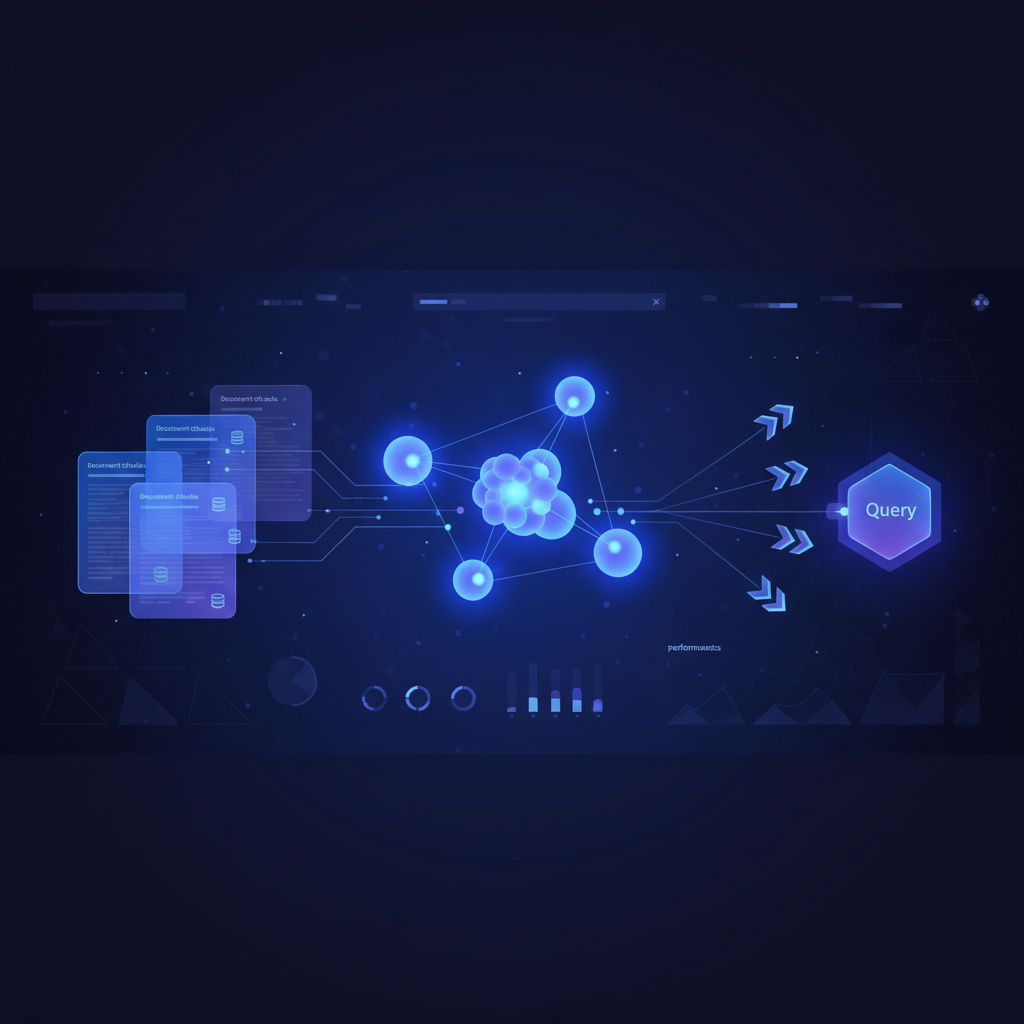

Um assistente RAG pronto para produção é um sistema de AI que recupera documentos relevantes e atualizados no momento da consulta, utilizando-os como contexto fundamentado para a geração, com citações, controles de segurança e monitoramento. Na prática, ele combina qualidade de recuperação, disciplina de prompt e governança para que as respostas permaneçam precisas, explicáveis e fáceis de manter à medida que o conhecimento muda.

O termo RAG vem do artigo original Retrieval-Augmented Generation (Lewis et al., NeurIPS 2020), que combina o conhecimento paramétrico do modelo com memória não paramétrica. A principal vantagem é operacional: você pode atualizar sua base de conhecimento sem precisar treinar o modelo novamente para cada mudança de conteúdo.

Na Optijara, tratamos o RAG como um problema de design de sistema, não como um simples truque de prompt. Uma boa implementação exige pipelines de documentos claros, embeddings fortes, chunking robusto, avaliação de recuperação, restrições de estilo de resposta e controles de segurança que reduzam modos de falha evitáveis.

Por que as equipes devem usar RAG em vez de respostas baseadas apenas no modelo?

As equipes devem usar RAG quando a precisão, a atualidade e a rastreabilidade da fonte são fundamentais, pois as respostas baseadas apenas no modelo podem ser fluentes, porém desatualizadas ou inverificáveis. O RAG melhora a confiabilidade prática ao fundamentar os resultados em documentos controlados e permitir citações, auditabilidade e atualizações mais rápidas, que são essenciais em fluxos de trabalho jurídicos, corporativos, de saúde e de suporte técnico.

O artigo sobre RAG de 2020 relata que as configurações aumentadas por recuperação alcançaram resultados de última geração (state-of-the-art) em três tarefas de QA de domínio aberto e produziram resultados mais factuais do que uma linha de base forte apenas paramétrica. Isso não elimina erros, mas valida a direção arquitetônica para tarefas intensivas em conhecimento.

O comportamento dos desenvolvedores também apoia essa mudança. Na pesquisa de 2024 do Stack Overflow, 62% dos entrevistados relataram usar ferramentas de AI atualmente e 76% estavam usando ou planejando usá-las em fluxos de trabalho de desenvolvimento. À medida que o uso de AI cresce, a fundamentação e a verificação tornam-se requisitos operacionais, não complementos opcionais.

Como projetar uma arquitetura RAG confiável passo a passo?

Projete um RAG confiável separando as responsabilidades em cinco camadas: ingestão, indexação, recuperação, geração e avaliação. Cada camada deve ter contratos explícitos, métricas e caminhos de rollback. Essa abordagem modular evita o acoplamento oculto, facilita a depuração de incidentes e permite que as equipes melhorem os componentes de forma independente, sem desestabilizar todo o assistente.

- Ingestão: Colete documentos de fontes confiáveis, normalize formatos, remova duplicatas e rastreie metadados de versão.

- Indexação: Realize o chunking dos documentos, gere embeddings e armazene vetores com IDs de origem e carimbos de data/hora.

- Recuperação: Use recuperação híbrida (semântica + palavra-chave) e reranking opcional para maior precisão.

- Geração: Restrinja os prompts para responder apenas a partir do contexto recuperado e citar fontes.

- Avaliação: Meça a qualidade da recuperação e a qualidade da resposta separadamente antes do lançamento.

Esta arquitetura está alinhada com as orientações de consenso do AI Risk Management Framework do NIST: a confiabilidade deve ser projetada nos fluxos de trabalho de desenvolvimento, implantação e avaliação, e não corrigida após o lançamento.

Como preparar documentos e chunks para a melhor qualidade de recuperação?

Prepare os documentos preservando as fronteiras semânticas, mantendo os chunks compactos e anexando metadados ricos. Um bom chunking melhora o recall sem sobrecarregar a janela de contexto do modelo. Um padrão prático é o chunking baseado em cabeçalhos com sobreposição, seguido de ajuste iterativo baseado em consultas que falharam, em vez de contagens estáticas de tokens no estilo "tamanho único".

Use estas regras de documentos:

- Faça o chunking primeiro por cabeçalhos de seção e depois por tamanho de parágrafo.

- Mantenha o comprimento do chunk consistente (por exemplo, 300–700 tokens) com 10–20% de sobreposição.

- Armazene metadados: título, URL, idioma, área do produto, versão e data de atualização.

- Evite colocar tópicos não relacionados em um único chunk; isso prejudica a precisão da recuperação.

- Filtre conteúdos genéricos (navegação, textos de cookies, rodapés legais) antes de gerar o embedding.

O MTEB (Massive Text Embedding Benchmark) é amplamente utilizado para comparar a qualidade de embeddings em tarefas de recuperação e afins. Use os resultados do benchmark como ponto de partida, mas sempre valide em suas próprias consultas de domínio antes de selecionar um modelo de embedding.

Qual estratégia de recuperação funciona melhor para assistentes corporativos?

Para a maioria dos casos de uso corporativo, a recuperação híbrida com reranking apresenta o melhor desempenho em termos de trade-offs de produção: a busca semântica melhora o recall, a palavra-chave/BM25 melhora a precisão de correspondência exata e o reranking melhora a relevância final. Essa combinação reduz falhas frágeis em consultas repletas de acrônimos, IDs de políticas e terminologia específica de versão, comuns em bases de conhecimento internas.

Um pipeline de recuperação prático se parece com isto:

# 1) Recuperação semântica (top_k=20)

# 2) Recuperação por palavra-chave (top_k=20)

# 3) Mesclar + remover duplicatas

# 4) Rerank para top_k=6

# 5) Passar os melhores contextos para o gerador com template de citação

Comece com uma recuperação orientada ao recall e, em seguida, refine com o reranking. Equipes que otimizam demais a latência precocemente costumam prejudicar a relevância. Melhore a velocidade após estabelecer limites mínimos de qualidade em seu conjunto de avaliação.

Como escrever prompts que reduzam alucinações no RAG?

Escreva prompts que imponham explicitamente limites de evidência: responda a partir do contexto fornecido, cite fontes e declare incerteza quando a evidência estiver ausente. O padrão anti-alucinação mais forte não é apenas usar uma linguagem de "seja preciso"; são requisitos de saída estruturada somados a um comportamento de recusa quando a confiança na recuperação é baixa.

Use um padrão de sistema como:

Você é um assistente corporativo.

Regras:

1) Use apenas o contexto recuperado.

2) Se o contexto for insuficiente, diga: "Não tenho evidências suficientes nas fontes fornecidas."

3) Forneça citações como [Fonte: título, seção].

4) Separe fatos de recomendações.

Em seguida, valide as saídas com verificações automatizadas:

- Detector de citações ausentes

- Verificação de sobreposição entre afirmação e fonte

- Lista negra/branca de frases de política

- Guardrails de comprimento de resposta para fluxos críticos

Como avaliar a qualidade do RAG antes de entrar em operação?

Avalie o RAG com dois scorecards: qualidade de recuperação e qualidade de resposta. As métricas de recuperação mostram se a evidência correta foi encontrada; as métricas de resposta mostram se o modelo usou essa evidência corretamente. A separação dessas camadas evita diagnósticos errados e ajuda as equipes a corrigir o componente certo mais rapidamente.

| Camada | Métrica | Por que importa |

|---|---|---|

| Recuperação | Recall@k | Verifica se documentos relevantes aparecem nos top-k resultados. |

| Recuperação | nDCG@k | Recompensa a qualidade do ranking, não apenas a presença. |

| Geração | Fidelidade (Faithfulness) | Mede se as afirmações são apoiadas pelo contexto recuperado. |

| Geração | Precisão de citação | Confirma se as referências apontam para os trechos corretos da fonte. |

| UX | Taxa de sucesso da tarefa | Captura se os usuários realmente resolvem seu problema. |

Construa um conjunto de testes padrão-ouro (gold set) a partir de perguntas reais de usuários, incluindo prompts adversários e consultas ambíguas. Execute novamente as avaliações após qualquer alteração de modelo, embedding ou chunking, e bloqueie a implantação se a fidelidade cair abaixo do limite acordado.

Quais controles de segurança são obrigatórios para um assistente RAG em produção?

Controles obrigatórios incluem defesas contra injeção de prompt, validação de saída, acesso a ferramentas com privilégio mínimo e proteções de dados sensíveis. O Top 10 da OWASP para aplicações de LLM destaca riscos recorrentes, como injeção de prompt, manipulação insegura de saída e agência excessiva. Trate-os como requisitos básicos de engenharia, especialmente quando os assistentes podem disparar ações.

- Mitigação de injeção de prompt: Separe o conteúdo do usuário das instruções do sistema e dos esquemas de ferramentas.

- Manipulação insegura de saída: Sanitize as saídas do modelo antes da renderização ou execução.

- Controles de dados sensíveis: Redija PII/segredos nas etapas de ingestão e resposta.

- Governança de acesso: Aplique filtros de recuperação baseados em funções por identidade de usuário.

- Salvaguardas de ação: Adicione confirmação humana para operações destrutivas.

O AI RMF do NIST e o Generative AI Profile oferecem uma visão prática de governança: mapeie modos de falha, defina controles, meça o risco residual e itere. A segurança não é uma auditoria única; são operações contínuas.

Quanto custa manter um assistente RAG e como controlar os gastos?

O custo do RAG é impulsionado pelo uso de tokens, infraestrutura de recuperação e metas de latência. Você pode controlar os gastos reduzindo contextos desnecessários, usando caching e combinando o tamanho do modelo com a complexidade da tarefa. Comece com linhas de base de qualidade e, em seguida, otimize o custo por tarefa bem-sucedida, em vez do custo por solicitação isoladamente.

Os componentes de custo normalmente incluem:

- Geração de embeddings para indexação e atualizações de documentos

- Armazenamento e consultas em banco de dados vetorial

- Inferência de modelo de reranking (se ativado)

- Tokens de entrada/saída do modelo de geração

As referências de preços de exemplo devem sempre ser verificadas nas páginas oficiais dos fornecedores antes da publicação. Por exemplo, a página de preços da OpenAI documenta taxas baseadas em tokens e estruturas de preços de chamadas de ferramentas, e esses valores podem mudar. Use verificações agendadas e evite codificar premissas de forma rígida (hard-coding) em conteúdos públicos.

Como é uma implementação mínima em código?

Uma implementação mínima precisa de apenas quatro primitivas: embutir documentos, recuperar candidatos, construir um prompt restrito e gerar com citações. Mantenha a primeira versão intencionalmente simples, depois adicione reranking, caching e verificações de política assim que puder medir os erros de linha de base com consultas de usuários reais.

# Pseudocódigo para um loop RAG mínimo

query = user_input()

q_vec = embed(query)

semantic_hits = vector_db.search(q_vec, top_k=10)

keyword_hits = bm25.search(query, top_k=10)

contexts = rerank_and_select(semantic_hits + keyword_hits, top_k=6)

prompt = compose_prompt(

query=query,

contexts=contexts,

rules=[

"Use apenas o contexto fornecido",

"Cite cada afirmação factual",

"Se a evidência estiver ausente, diga isso"

]

)

answer = llm.generate(prompt)

return post_validate(answer)

Em produção, envolva isso com observabilidade (latência, taxas de acerto de recuperação, cobertura de citações), logs estruturados para revisão de incidentes e alertas quando a fidelidade ou o sucesso da tarefa degradarem.

Como as equipes devem implementar o RAG com segurança em 30 dias?

Implemente o RAG em 30 dias sequenciando o escopo: semana um para dados e perguntas de teste, semana dois para qualidade de recuperação, semana três para controles de resposta e portões de segurança, e semana quatro para monitoramento de piloto. Essa abordagem em fases reduz o risco de lançamento e oferece aos stakeholders pontos de verificação mensuráveis antes da implantação total.

- Semana 1: Defina as tarefas-alvo, faça a curadoria de documentos confiáveis, construa o conjunto de avaliação.

- Semana 2: Implemente chunking/indexação, ajuste a recuperação, realize benchmark de Recall@k e nDCG.

- Semana 3: Adicione prompts restritos, verificações de citação e salvaguardas alinhadas ao OWASP.

- Semana 4: Execute o piloto com usuários selecionados, analise falhas, finalize os critérios de go/no-go.

É aqui que a vantagem da Optijara importa: orientação de arquitetura consistente, templates de governança e práticas de otimização iterativa tornam os assistentes de AI mais fáceis de escalar entre equipes e regiões.

FAQ: Qual é a diferença entre fine-tuning e RAG?

O fine-tuning atualiza o comportamento do modelo por meio de treinamento adicional, enquanto o RAG mantém o modelo fixo e injeta evidências externas no momento da consulta. Use fine-tuning para estilo, formato ou comportamento de política; use RAG para conhecimento em constante mudança. Muitos sistemas de produção combinam ambos, mas o RAG costuma ser o caminho mais rápido para a atualização factual.

O RAG é operacionalmente mais barato de atualizar quando os documentos mudam diariamente. O fine-tuning ainda pode ajudar na estrutura de saída consistente ou no tom do domínio, mas não deve ser seu mecanismo principal para fatos que mudam com frequência.

FAQ: O RAG pode eliminar as alucinações completamente?

Não, o RAG não pode eliminar as alucinações completamente, mas pode reduzi-as significativamente quando a qualidade da recuperação, o prompting e a validação são bem projetados. Falhas ainda ocorrem por meio de recuperação irrelevante, ranking fraco ou inferências do modelo não suportadas. Trate o RAG como uma arquitetura de redução de risco, não como uma garantia, e mantenha caminhos de escalonamento humano para decisões de alto risco.

Seu objetivo é uma redução mensurável em afirmações não suportadas, com monitoramento claro e resposta a incidentes quando a qualidade cair.

FAQ: Qual é um bom tamanho inicial de chunk para documentos corporativos?

Uma faixa inicial prática é de 300 a 700 tokens com sobreposição moderada, ajustando-se posteriormente pelo desempenho da consulta. Chunks menores podem melhorar a precisão, mas prejudicam a completude do contexto, enquanto chunks maiores podem diluir a relevância. Avalie o tamanho do chunk em relação ao seu próprio conjunto de dados e perguntas, em vez de copiar padrões genéricos de tutoriais.

O chunking baseado em cabeçalhos geralmente supera a divisão de tamanho fixo porque preserva as fronteiras de significado que os modelos de recuperação e rerankers podem explorar.

FAQ: Quais métricas a liderança deve acompanhar semanalmente?

A liderança deve acompanhar a taxa de sucesso da tarefa, a precisão da citação, a taxa de consultas não resolvidas, o percentil de latência e o custo por tarefa bem-sucedida. Essas métricas alinham os resultados de negócios com a qualidade técnica e a eficiência operacional. Monitorar apenas o gasto de tokens ou apenas a precisão do modelo cria pontos cegos que podem esconder problemas de confiabilidade ou confiança.

Mantenha um dashboard para executivos e outro para a profundidade da engenharia. Definições compartilhadas evitam interpretações conflitantes entre as equipes.

Fontes

- Lewis et al. (2020), Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks

- NIST AI Risk Management Framework (AI RMF)

- OWASP Top 10 for LLM Applications / GenAI Security Project

- MTEB: Massive Text Embedding Benchmark (GitHub)

- Stack Overflow Developer Survey 2024 — AI section

- OpenAI API Pricing

Escrito por

Optijara AI