A expansão da infraestrutura de AI de um trilhão de dólares: o que os desenvolvedores precisam saber

A NVIDIA dobrou sua previsão de demanda por chips de AI para um trilhão de dólares no GTC 2026. Hyperscalers planejam 720 bilhões em capex combinado este ano. Veja o que a expansão da infraestrutura significa para desenvolvedores e fundadores.

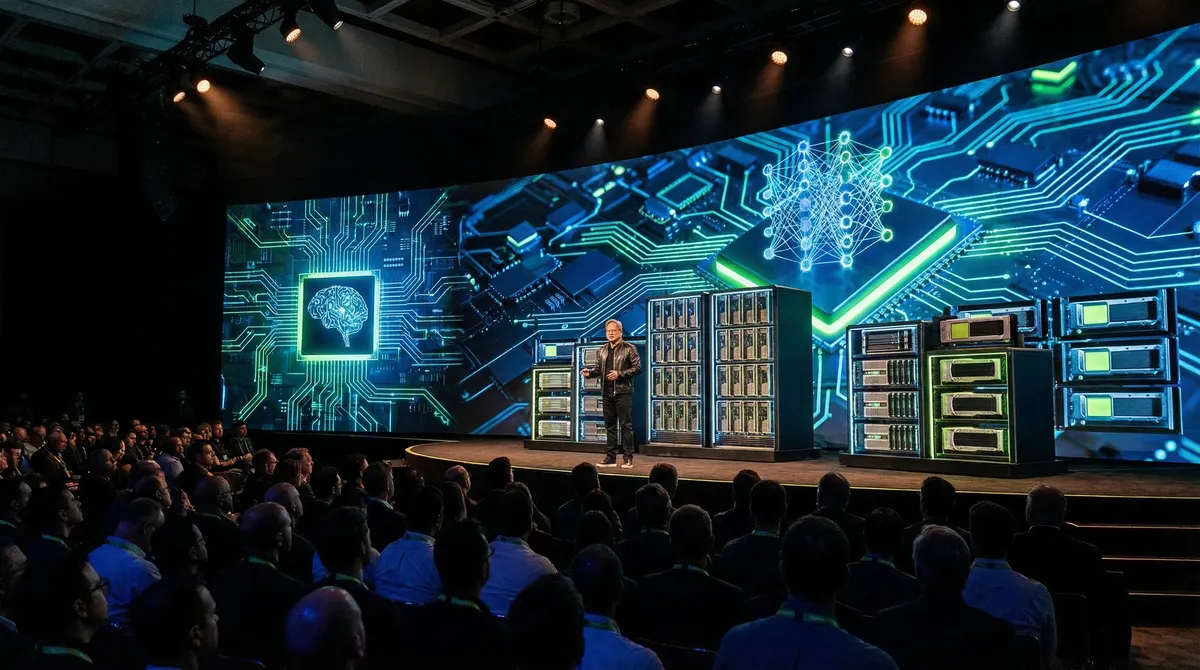

No GTC 2026, em 17 de março, o CEO da NVIDIA, Jensen Huang, dobrou a previsão de demanda de sua empresa: "Pelo menos US$ 1 trilhão até 2027", disse ele. "Na verdade, vamos ficar aquém. Tenho certeza de que a demanda por computação será muito maior do que isso". A estimativa anterior, feita durante a teleconferência de resultados da NVIDIA em fevereiro, era de US$ 500 bilhões. Em um mês, a oportunidade projetada dobrou.

Este não é um sinal isolado. Os quatro maiores hyperscalers — Alphabet, Meta, Microsoft e Amazon — orientaram coletivamente para US$ 700 bilhões em despesas de capital (capex) para 2026. Somente a Meta assinou um acordo de infraestrutura de US$ 27 bilhões com a Nebius e planeja até US$ 135 bilhões em capex relacionado à AI este ano. A Amazon projetou US$ 200 bilhões, US$ 50 bilhões a mais do que os analistas esperavam.

Para desenvolvedores, fundadores e líderes técnicos, esses números se traduzem em mudanças reais: onde a computação está disponível, quanto custa, como as aplicações são construídas e quais decisões de infraestrutura serão mais importantes nos próximos 12 a 18 meses.

Quão grande é a expansão da infraestrutura de AI?

O capex de AI combinado dos hyperscalers para 2026 aproxima-se de US$ 720 bilhões no limite superior das projeções. Para colocar isso em contexto, esse valor rivaliza com o PIB da Suécia e excede o dobro do custo ajustado pela inflação de todo o programa Apollo. A receita da NVIDIA no ano fiscal de 2026 atingiu US$ 215,9 bilhões, um aumento de 65% em relação ao ano anterior, com a receita de data centers sozinha em US$ 62,3 bilhões no quarto trimestre.

Os gastos globais com TI devem ultrapassar US$ 6 trilhões pela primeira vez em 2026, de acordo com o Gartner. As cargas de trabalho de AI são o principal motor de crescimento, com 42% das organizações citando a otimização do fluxo de trabalho de AI como sua principal prioridade de gastos.

Para onde o dinheiro está indo

Os gastos são divididos em várias categorias que afetam diretamente o ecossistema de desenvolvedores:

Aquisição de GPUs e aceleradores. Os chips de AI Blackwell e Rubin da NVIDIA continuam sendo os alvos principais. A previsão de US$ 1 trilhão reflete a demanda por inferência (execução de modelos treinados em produção) tanto quanto pelo treinamento. Jensen Huang destacou especificamente a mudança para cargas de trabalho de inferência como a maior oportunidade de receita.

Construção de data centers. Novas instalações estão sendo construídas em uma escala sem precedentes. O acordo de US$ 27 bilhões da Meta com a Nebius cobre a implantação de infraestrutura de AI em várias regiões. Microsoft, Amazon e Google estão construindo instalações em escala de campus projetadas especificamente para cargas de trabalho de AI, com sistemas de resfriamento personalizados e arquiteturas de fornecimento de energia.

Infraestrutura de energia. Os data centers de AI consomem significativamente mais eletricidade do que as instalações de nuvem tradicionais. Isso criou uma expansão paralela de infraestrutura em energia: nova geração de energia, atualizações de rede e instalações de geração no local. A demanda de energia é substancial o suficiente para que a NVIDIA anunciasse conceitos de computação baseada no espaço no GTC 2026, e Elon Musk discutiu a computação orbital como uma solução potencial para as restrições de energia terrestre.

Redes e interconexão. Conexões de alta largura de banda entre clusters de GPUs e entre data centers são um centro de custo crescente. As tecnologias NVLink e InfiniBand da NVIDIA abordam a comunicação intra-cluster, enquanto os hyperscalers investem em redes de fibra dedicadas entre regiões.

A economia da inferência: uma mudança estrutural

A previsão de US$ 1 trilhão da NVIDIA visa especificamente a oportunidade de inferência. Treinar um modelo grande é um custo único (ou periódico). Executar esse modelo em escala — inferência — é contínuo e escala com a demanda do usuário.

Essa mudança é importante para desenvolvedores e fundadores por vários motivos:

| Aspecto | Era do Treinamento | Era da Inferência |

|---|---|---|

| Estrutura de custos | Antecipado, em lote | Contínuo, por requisição |

| Prioridade de hardware | Computação bruta | Latência + throughput |

| Preocupação com escala | Tamanho do modelo | Usuários simultâneos |

| Impacto para o desenvolvedor | Poucas equipes treinam modelos | Todo app executa inferência |

| Modelo de negócio | Baseado em pesquisa | Baseado em uso |

A economia da inferência significa que o custo e a disponibilidade da execução de modelos de AI em produção determinam diretamente quais aplicações são economicamente viáveis. À medida que a infraestrutura escala, os custos de inferência caem, permitindo novas categorias de aplicações que antes eram caras demais para operar.

O que isso significa para os desenvolvedores

A computação está se tornando mais acessível, não menos. Apesar dos números impressionantes de capex, a expansão está aumentando a oferta mais rápido do que a demanda para muitos níveis de carga de trabalho. APIs de inferência serverless de provedores de nuvem, endpoints de inferência especializados de fornecedores de modelos e opções de implantação na borda (edge) estão todos em expansão. Desenvolvedores que constroem aplicações sobre modelos de fundação verão uma melhoria nas relações preço-desempenho ao longo de 2026 e 2027.

Estratégias multi-cloud e multi-provedor são agora essenciais. Nenhum hyperscaler sozinho pode absorver toda a demanda. Os desenvolvedores devem arquitetar aplicações para funcionar entre provedores, usando camadas de abstração que permitam alternar entre endpoints de inferência. Isso é especialmente importante para startups que podem não querer se comprometer com a trajetória de preços de um único fornecedor.

A inferência na borda (edge) está acelerando. Nem todas as cargas de trabalho precisam de GPUs de data center. O Apple Silicon, os aceleradores de AI da Qualcomm e a plataforma Jetson da NVIDIA estão permitindo inferência significativa na borda. Para aplicações sensíveis à latência (tradução em tempo real, sistemas autônomos, assistentes no dispositivo), a expansão da infraestrutura inclui computação local, não apenas escala de nuvem.

A relação modelo-infraestrutura está mudando. À medida que a infraestrutura escala, o gargalo muda de "podemos executar este modelo?" para "podemos executá-lo de forma eficiente?". Técnicas como quantization, distillation, speculative decoding e arquiteturas mixture-of-experts tornam-se habilidades essenciais do desenvolvedor, em vez de tópicos de pesquisa.

O que isso significa para os fundadores

Os custos de infraestrutura de AI são agora um item de linha principal. Para qualquer startup que utilize AI, os custos de computação são provavelmente a maior ou a segunda maior categoria de despesas. Entender como otimizar os custos de inferência — seleção de modelo, estratégias de lote (batching), camadas de cache e negociação com provedores — é uma competência central, não um exercício de otimização.

A janela para startups nativas de AI está aberta, mas se estreitando. A expansão dos hyperscalers cria uma capacidade massiva que eventualmente tornará muitas capacidades de AI commodities. Startups que constroem diferenciação defensável por meio de dados proprietários, ajuste fino (fine-tuning) específico de domínio ou arquiteturas de aplicações inovadoras têm uma janela agora, enquanto a infraestrutura ainda está sendo implantada. Competir em capacidade bruta de modelo contra empresas que gastam mais de US$ 100 bilhões anualmente não é uma estratégia viável.

A distribuição geográfica importa. A expansão da infraestrutura não é uniforme. Os Estados Unidos, partes da Europa e mercados asiáticos selecionados estão recebendo a maior parte da nova capacidade. Fundadores que visam mercados emergentes devem considerar uma latência mais alta e custos potencialmente mais elevados para cargas de trabalho de AI nessas regiões.

Economia de tokens: uma prévia de como a AI reformula a remuneração

No GTC 2026, Jensen Huang introduziu um conceito que sinaliza quão profundamente a infraestrutura de AI está penetrando nas operações organizacionais: pagar engenheiros em tokens de AI como um suplemento ao salário base.

"Cada engenheiro em nossa empresa precisará de um orçamento anual de tokens", disse ele. "Eles ganharão algumas centenas de milhares por ano como salário base. Vou dar a eles provavelmente metade disso em tokens para que possam ser amplificados 10 vezes."

Nos níveis descritos, os engenheiros teriam acesso a bilhões de tokens anualmente. Huang enquadrou isso como uma ferramenta de recrutamento competitiva: "Agora é uma das ferramentas de recrutamento no Vale do Silício: quantos tokens acompanham o meu trabalho".

Independentemente de a remuneração por tokens se tornar generalizada, a lógica subjacente é significativa. As empresas estão começando a tratar a computação de AI como um multiplicador de produtividade que tem valor quantificável por funcionário. Isso tem implicações em como as organizações orçam, como medem a produtividade do desenvolvedor e como estruturam pacotes de remuneração em mercados competitivos.

Riscos e questões em aberto

Isso é uma bolha? O CEO da Microsoft, Satya Nadella, e o investidor Michael Burry sinalizaram o excesso de investimento em AI como uma preocupação. O contra-argumento: o crescimento da receita da NVIDIA (65% YoY para US$ 215,9 bilhões) demonstra que a demanda é real e atual, não especulativa. O risco não é que a demanda não exista, mas que a expansão da oferta possa ultrapassar o necessário em segmentos específicos do mercado.

Sustentabilidade energética. O consumo de energia dos data centers de AI é uma restrição genuína. A indústria está investindo em energia nuclear, solar e atualizações de rede, mas o cronograma para a nova geração de energia nem sempre coincide com o cronograma para a implantação de novos data centers.

Risco de concentração. A NVIDIA controla a maioria do mercado de aceleradores de AI. A AMD tem lutado para diminuir a diferença, apesar das discussões sobre o acordo de chips de US$ 100 bilhões da Meta. Essa concentração cria um risco na cadeia de suprimentos para todo o ecossistema e mantém o poder de precificação firmemente com a NVIDIA.

Principais conclusões

- A NVIDIA dobrou sua previsão de demanda por chips de AI para US$ 1 trilhão até 2027, acima dos US$ 500 bilhões de apenas um mês antes.

- Os quatro maiores hyperscalers planejam aproximadamente US$ 700-720 bilhões em capex de AI combinado para 2026.

- Os gastos estão mudando do treinamento para a inferência, o que afeta diretamente a economia das aplicações.

- Os desenvolvedores devem arquitetar para flexibilidade multi-provedor e investir em habilidades de otimização de inferência.

- Os fundadores precisam tratar os custos de computação de AI como uma competência central, não como algo secundário.

- A remuneração baseada em tokens está surgindo como um diferencial de recrutamento no Vale do Silício.

FAQ

Por que a NVIDIA dobrou sua previsão de demanda tão rapidamente?

O aumento de US$ 500 bilhões para US$ 1 trilhão reflete a mudança para cargas de trabalho de inferência. O treinamento cria uma demanda pontual, mas a inferência escala com cada usuário da aplicação. À medida que mais aplicações em produção adotam recursos de AI, a demanda por inferência cresce mais rápido do que os modelos anteriores projetavam.

Como os gastos dos hyperscalers afetam os fundadores de startups?

Isso aumenta a capacidade de computação disponível, o que geralmente reduz os custos de inferência ao longo do tempo. No entanto, também significa que os hyperscalers oferecerão mais recursos de AI integrados em suas plataformas, potencialmente tornando commodities recursos pelos quais as startups cobram atualmente. Os fundadores devem construir diferenciais defensáveis por meio de dados proprietários ou arquiteturas de aplicações exclusivas.

O gasto em infraestrutura de AI é uma bolha?

As evidências atuais sugerem que a demanda é real: a NVIDIA registrou US$ 215,9 bilhões em receita com crescimento de 65%, e os hyperscalers relatam forte retorno sobre os investimentos em AI. O risco reside no potencial excesso de oferta em segmentos específicos ou em uma desaceleração na adoção de AI corporativa que não acompanhe o ritmo de expansão da infraestrutura.

O que os desenvolvedores devem aprender para se preparar?

Foque na otimização de inferência: quantization, model distillation, speculative decoding e batching eficiente. Compreender a implantação multi-cloud e a otimização de custos entre provedores será cada vez mais valioso à medida que o cenário da infraestrutura se expande.

Os custos de inferência continuarão a cair?

Sim, com base em tendências históricas e na escala do investimento atual. Mais oferta, melhor hardware (como a arquitetura Rubin da NVIDIA) e otimizações de software (mixture-of-experts, mecanismos de atenção eficientes) devem continuar reduzindo os custos ao longo de 2026-2027.

Fontes

- https://www.reuters.com/world/asia-pacific/nvidia-ceo-set-reveal-new-chips-software-ai-megaconference-gtc-2026-03-16/

- https://fortune.com/2026/03/17/jensen-huang-ai-infrastructure-buildout-1-trillion-dollars/

- https://www.cnbc.com/2026/03/16/meta-nebius-ai-infrastructure.html

- https://blogs.nvidia.com/blog/state-of-ai-report-2026/

- https://finance.yahoo.com/news/hyperscalers-spending-nearly-700-billion-115600158.html

- https://www.fool.com/investing/2026/03/17/big-tech-is-spending-720-billion-on-ai-in-2026-and/

- https://www.fool.com/investing/2026/03/14/it-spending-will-exceed-6-trillion-for-the-first-t/ ## Conclusão - A NVIDIA dobrou sua previsão de demanda por chips de IA para US$ 1 tril ## Principales Puntos - O CEO da NVIDIA, Jensen Huang, dobrou a previsão de demanda por comput

Escrito por

Optijara